图A: Claude在一台旧式电话亭前,拿着一大摞纸。 Claude: “我觉得我终于搞懂了区块链!现在我可以开始挖比特币了!” 电话亭上传来:嘟嘟声 图B: Claude拿着一个巨大的账单,脸色苍白。 账单标题:API使用费 Claude: “咦?为什么我的API账单涨了100倍?!”

Birkaç gün önce, AMD AI Ekibi Lideri Stella Laurenzo, Claude Code resmi deposunda "Claude Code'un Karmaşık Mühendislik Görevleri İçin Artık Kullanılamaz" başlıklı bir sorun bildirisi yayınladı. Bu, duygusal bir şikayet değil, ancak 6.800 oturuma dayalı nicel bir analize dayanan bir rapordu. Bu rapor, AI topluluğunun en isteksiz olduğu sorunları masaya yatırdı, özellikle dikkat çekici bir grup sayı vardı: Anthropic'in hesaplama gücünden tasarruf etmek için yaptığı yapılandırma ayarlaması, bu ekibin API aylık faturasını 345 dolardan 42.121 dolara yükseltti.

Laurenzo'nun ekibi, 235.000 araç çağrısını, 18.000 ipucunu izledi ve 2026 Şubat ayından bu yana Claude Code'un sistem performansında yaşanan sistematik bir düşüşü belgeledi. Bu rapor daha sonra The Register tarafından bildirildi ve geliştirici topluluğunda iki haftalık süren bir tartışma fırtınasına neden oldu.

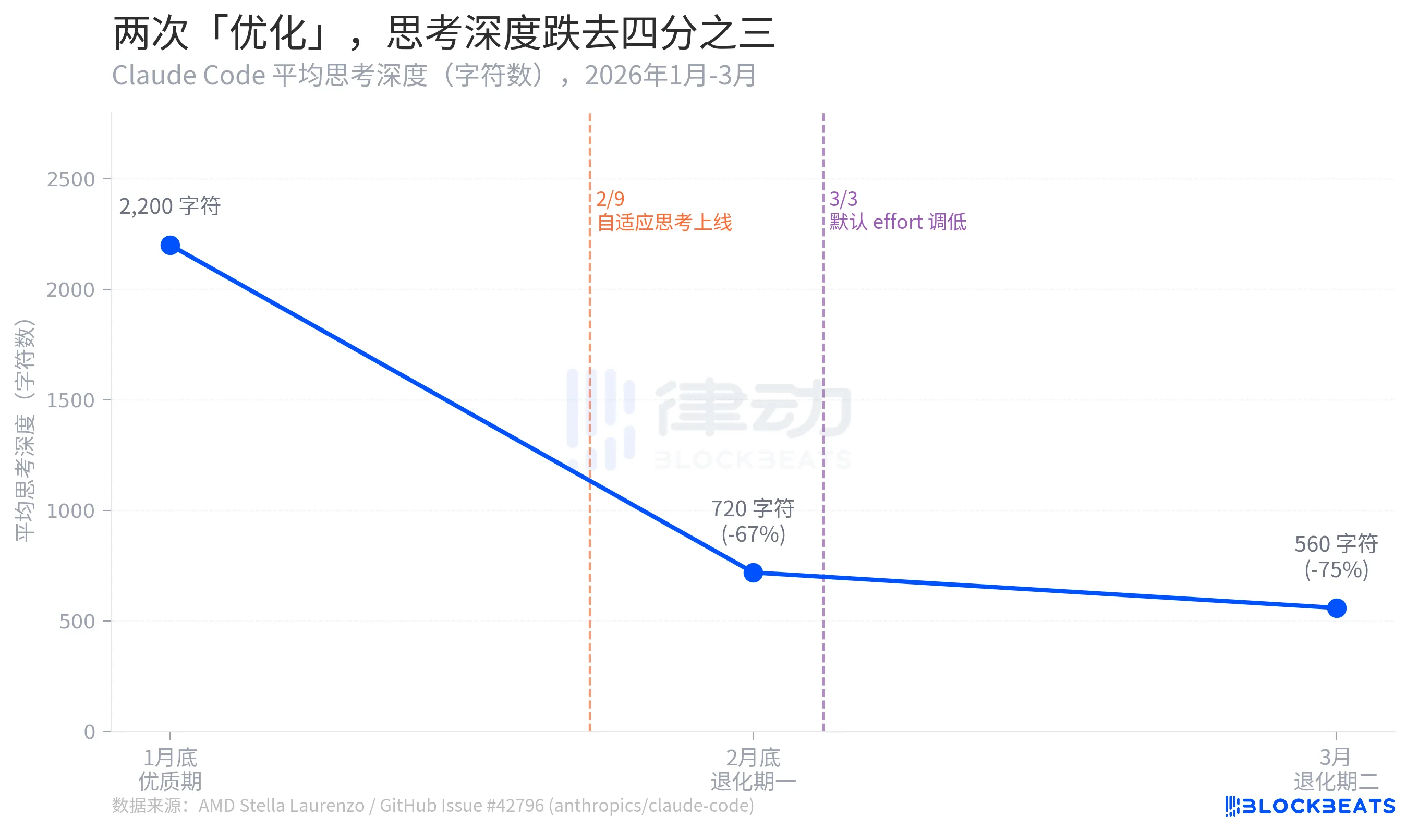

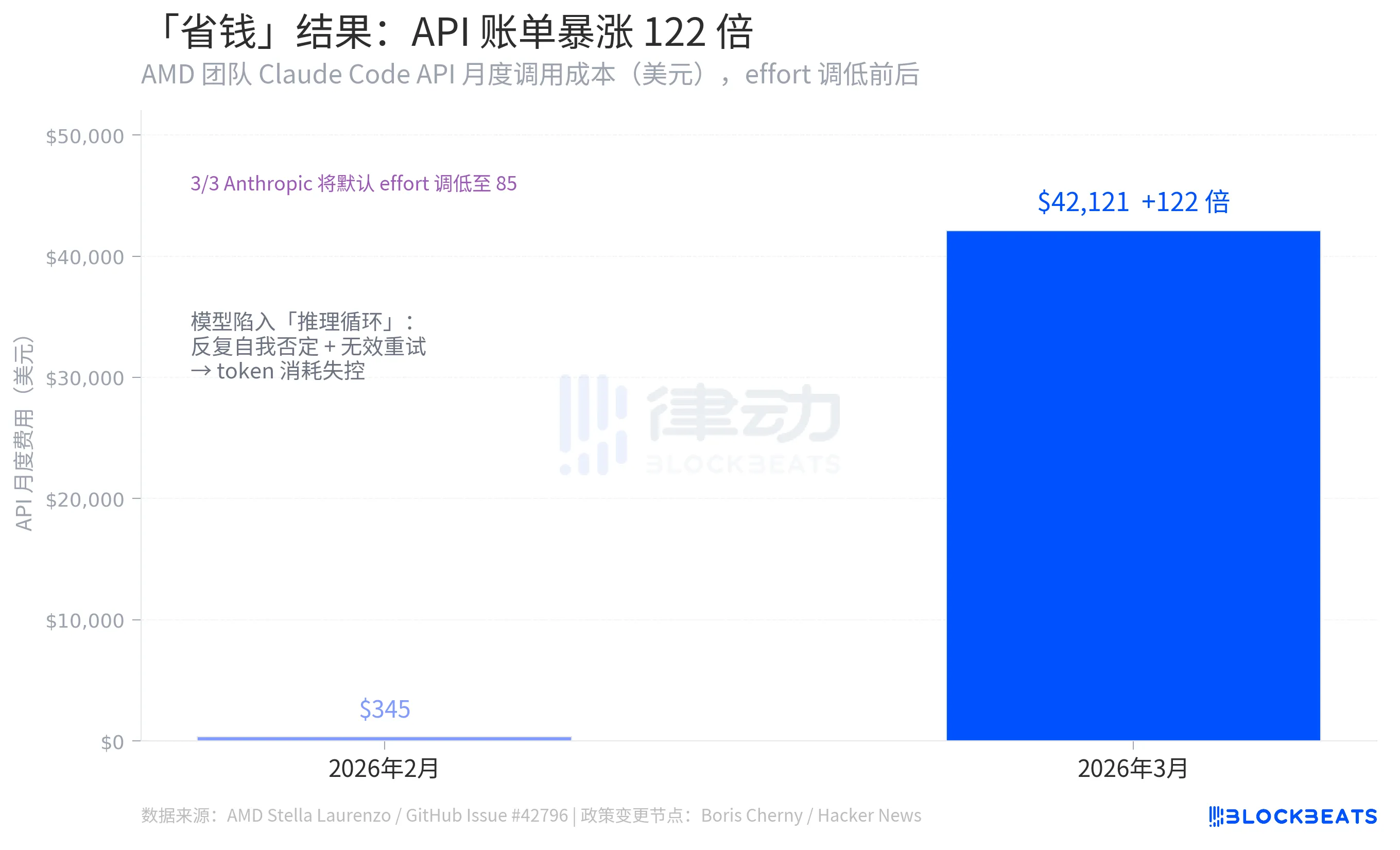

Anthropic Claude Code Ekibi Lideri Boris Cherny, Hacker News'de açıklamalarda bulundu. 9 Şubat'ta Opus 4.6 ile birlikte yayınlandığında, modelin kendi kendine karar verdiği düşünme süresini belirleyen "Adaptif Düşünme" mekanizması varsayılan olarak etkinleştirildi. 3 Mart'ta, Anthropic, varsayılan düşünme yoğunluğunu (çaba) 85'e düşürdü. Resmi açıklama, "Zeka, Gecikme ve Maliyet arasındaki en iyi denge noktası" idi. Bu iki ayar değişikliğinin gerçek etkileri, verilerle çok açık bir şekilde ortaya kondu.

Düşünme Derinliği, Dörtte Üç Oranında Azaldı

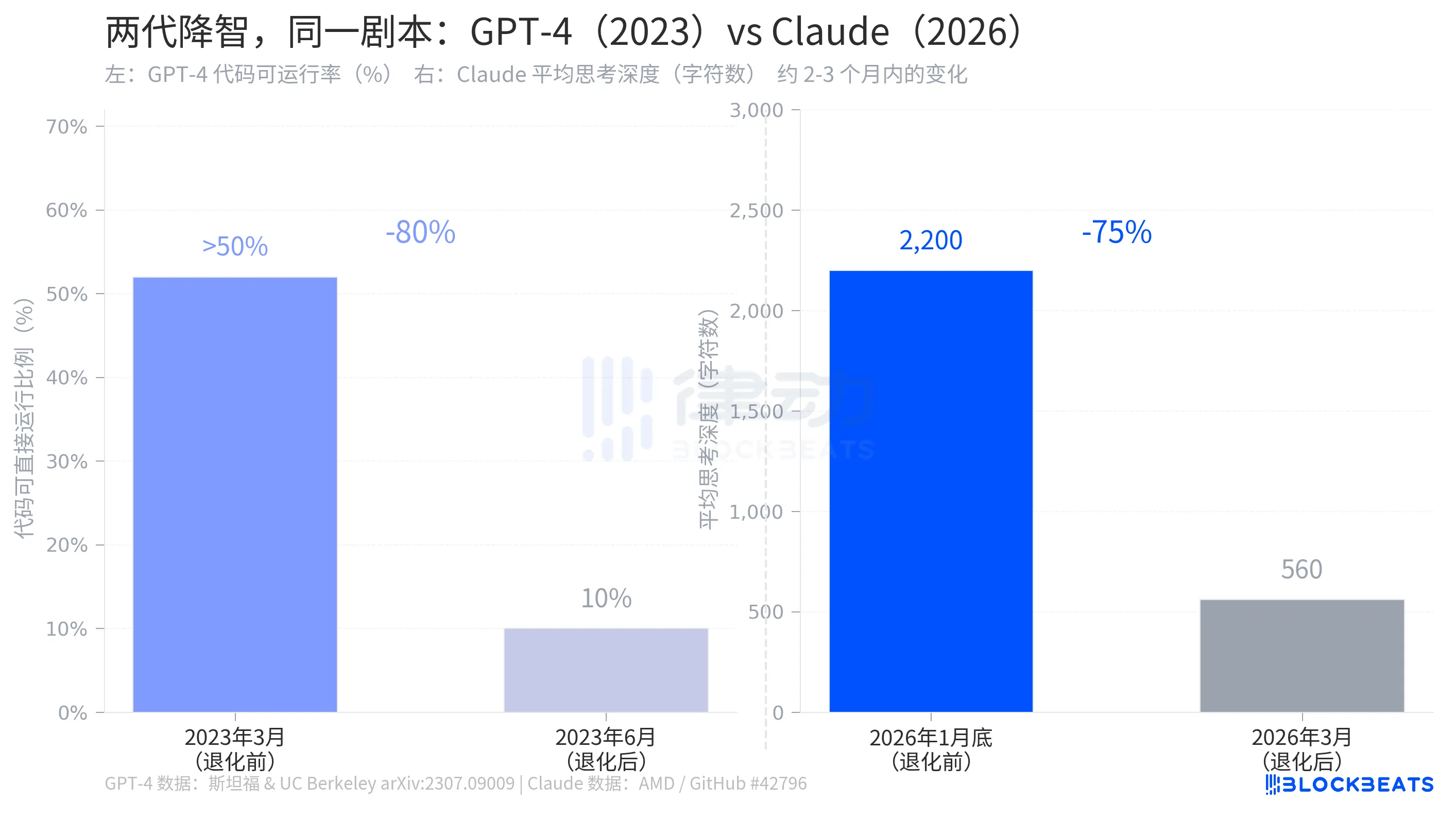

Stella Laurenzo'nun GitHub Sorunu verilerine göre, Claude Code'un ortalama düşünme derinliği, iki ay içinde üç aşamalı bir çöküş yaşadı: Ocak sonundaki 2.200 karakterlik zirveden, Şubat sonuna kadar 720 karaktere düşerek% 67 azaldı. Mart ayında daha da düşerek 560 karaktere indi ve zirveden% 75 azaldı.

Düşünme derinliği burada bir vekil gösterge olarak kullanılır ve modelin bir yanıt vermeden önce ne kadar "içsel çıkarım" yatırımı yapmaya istekli olduğunu yansıtır. 2.200 karakter ile 560 karakter arasındaki fark, yaklaşık olarak "taslak yazıp sonra cevap verme"den "birkaç saniye düşünüp konuşmaya başlama"ya düşüşe eşdeğerdir.

Laurenzo ayrıca, erken Mart ayında kullanıma sunulan "Düşünme İçeriği Gizleme" özelliğine (redact-thinking-2026-02-12) işaret etti ve bu özelliğin modelin çözümleme sürecini maskelediğini, kullanıcıların küçülme sürecini doğrudan algılayamadığını belirtti. Boris Cherny, bu durumun sadece bir arayüz değişikliği olduğunda ısrar etti ve altta yatan çıkarımı etkilemediğini belirtti. Teknik olarak her iki açıklama da doğru olsa da, kullanıcı tarafından bakıldığında, sonuçlar açısından bir farklılık bulunmamaktadır.

Boris Cherny daha sonra, çabasını manuel olarak en yükseğe ayarlasa bile, adaptif düşünme mekanizmasının bazı turmalarda mantık eksikliği dağıtması olasılığı olduğunu kabul etti ve yanılsama içeriği üretebileceğini belirtti. "En yüksek çabaya geri dön" çözümü tam anlamıyla bir çözüm değildir, bu yalnızca düğmeyi orijinal konumuna yakın bir yere geri çevirir ve belirsizliğe geri dönüş yapar.

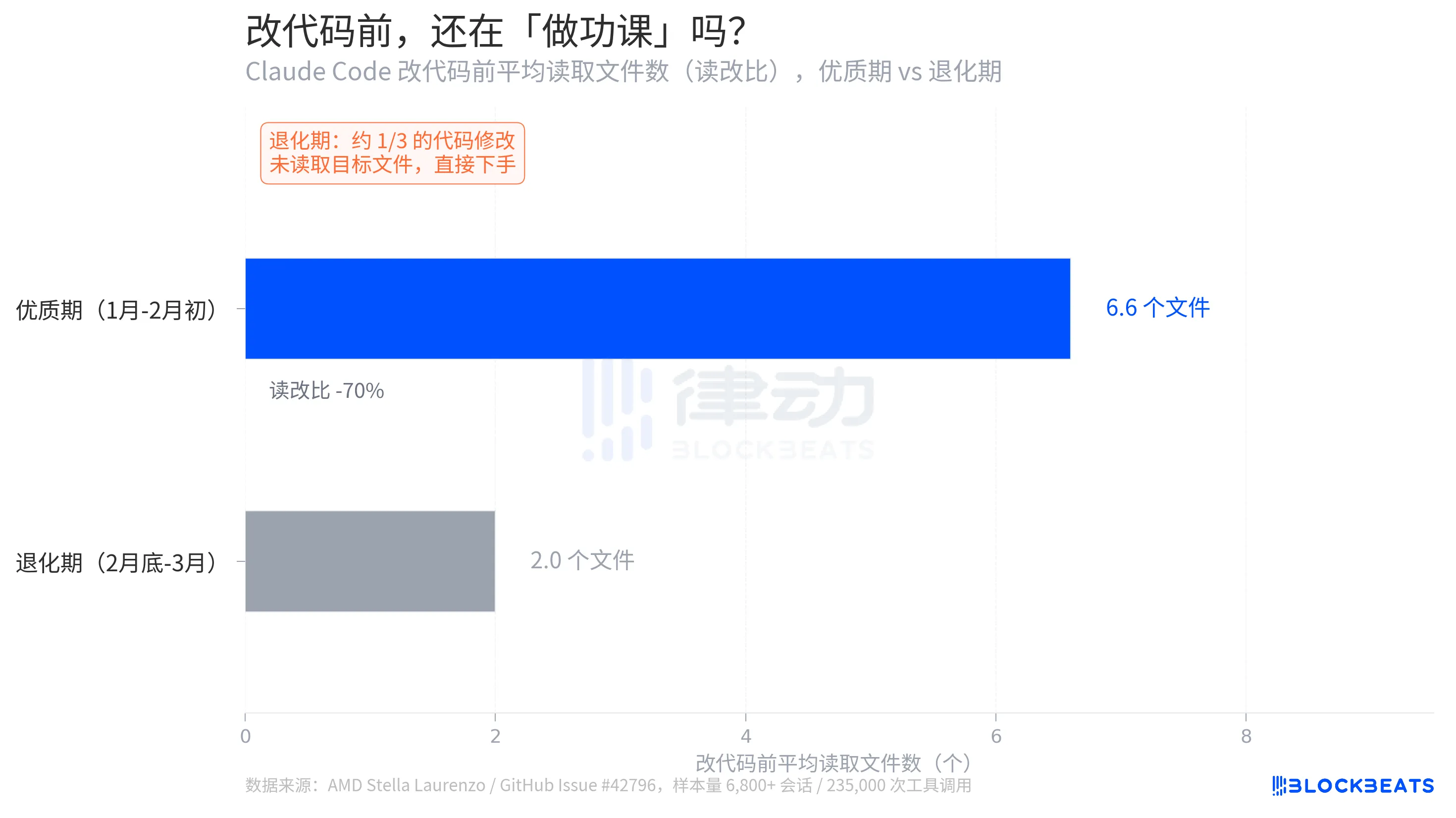

“Araştırmacı Geliştiriciden” “Kör Düzenleyici Geliştiriciye”

Stella Laurenzo'nun raporunda, düşünceden daha açık bir detay vardır: Kodu değiştirmeden önce model kaç ilgili dosyayı okuyacak.

GitHub Sorunları verilerine göre, Kalite Dönemi'nde ortalama okuma/değiştirme oranı 6.6'dir; bir kod değişikliği yapmadan önce, model ortalama olarak önce 6.6 dosya okur ve bağlamı anlar. Bozulma Dönemi'nde bu rakam 2.0'ye düşer; %70 azalır. Daha da kötüsü, kod değişikliklerinin yaklaşık üçte biri, modelin hedef dosyayı okumadan doğrudan yapıldı.

Laurenzo buna "kör düzenleme" (blind edits) diyor. Mühendislik açısından, bu, bir geliştiricinin fonksiyon imzasını görmeden, değişken türünü bilmeden kod yazmaya başlamasıyla eşdeğerdir. “Benim takımımdaki her bir kıdemli mühendis benzer durumlarla karşılaştı,” diye raporunda yazdı, "Claude artık karmaşık mühendislik görevlerini yerine getirmek için güvenilir bir şekilde kullanılamıyor."

Okuma/değiştirme oranının 6.6'dan 2.0'ye düşmesi, bir davranış ölçeğinin değişmesi gibi görünse de, altında yatan şey görev başarı oranındaki çöküştür. Modern kod depolarının karmaşıklığı, herhangi bir değişikliğin çok sayıda dosya arasındaki bağımlılıkları içermesine neden olur. Bağlamı atlama ve doğrudan değişiklik yapma, yanlış cevap vermek değil, "doğru görünmesine rağmen, aşağı akımda yeni hatalara neden olan" hatalara yol açar. Bu tür hataların tespit maliyeti, açık bir yanıtın başarısızlığından çok daha yüksektir.

“Tasarruf” Yanlış Hesaplandı

Bu olaydaki en aksi mantıklı grup sayıları, aynı GitHub Sorunları verisinden gelir: Stella Laurenzo'nun ekibinin Claude Code API'nın aylık çağrı maliyeti, Şubat 2026'daki 345 ABD Dolarından, Mart ayında 42,121 ABD Dolarına yükseldi, 122 kat arttı.

Anthropic, çabanın düşürülmesinin mantığı, tek bir çağrıda kullanılan jeton tüketimini azaltarak maliyeti düşürmektir. Ancak sonuç tam tersidir. Model bozulduktan sonra, büyük miktarda "muhakeme döngüsü" (Reasoning Loops) oluşmuş, tek bir cevapta kendini tekrarlayarak, sürekli olarak tekrar başlamış ve harcanan jeton miktarı, tasarruf edilen miktarın çok ötesine geçmiştir. Stella Laurenzo'nun verilerine göre, aynı dönemde görevi aktif olarak sonlandıran kullanıcı oranı 12 kat artmış, geliştiriciler sürekli olarak müdahale etmek, hataları düzeltmek ve tekrar göndermek zorunda kalmıştır.

Arkasındaki mantık bir sistem hatasıdır. Karmaşık görevlerde işlem gücünü azaltmak, maliyeti basitçe düşürmeyecektir. Bir düşünce eşiğinin altına indikten sonra, model sapmaya başlar ve toplam maliyet tersine döner. Çabasını azaltmak basit sorgularda para tasarruf etti, ancak kod mühendisliği görevlerinde faturayı patlattı.

“Zihniyetin Düzeyi” Meselesi, GPT-4 Yıllar Önce Yaşadı

2023 Temmuz'unda, Stanford Üniversitesi ve California Üniversitesi, Berkeley'deki bir araştırma ekibi, arXiv'de “How is ChatGPT's behavior changing over time?” başlıklı makalelerini yayınladı ve aynı olayın GPT-4 üzerinde nasıl gerçekleştiğini belgeledi.

Araştırma verilerine göre, 2023 Mart'ta GPT-4, üretilen kodun %50'sinden fazlasını doğrudan çalıştırabilir durumdaydı. Haziran ayına gelindiğinde, bu oran %10'a düştü, %80 oranında bir azalma, üç aylık bir süreçte gerçekleşti. Aynı dönemde, asal sayı tanıma doğruluğu %97.6'dan %2.4'e düştü. OpenAI'nin ve Anthropic'in yanıtları oldukça benzerdi: Arka planda iyileştirmeler yapıldı, bu normal bir iterasyon sürecidir.

İki hikayenin yapısı neredeyse aynı, bir yapay zeka şirketi modelin yeteneklerini etkileyen parametreleri sessizce ayarladı, kullanıcılar fark etti, şirket ayarlamaların olduğunu kabul etti, ancak nedeninin “daha makul bir kaynak tahsisi” olduğunu açıkladı. GPT-4'ün zayıflaması 2023'te meydana geldi, Claude'ın zayıflaması ise 2026'da meydana geldi, ikisi arasında üç yıl fark var, senaryo aynıdır.

Bu belirli bir şirketin özel bir hata olması değil. AI abonelik modelinin ekonomik mantığı, çıkarsama maliyetinin fiyatlandırma kapsamını aştığında, üreticinin karşılaştığı baskı aynıdır. Varsayılan düşünce yoğunluğunu azaltmak, maliyet ve performans arasındaki şu anda en kolay ayarlanabilir olan düğmeyi hareket ettirmektir. Kullanıcıların algısı, modelin “aptallaştığı” yönündedir. Üreticinin maliyette tasarruf ettiği şey, her çağrının marjinal token maliyetidir.

Boris Cherny, teknik bir çözüm sunmuş olup, kullanıcılar, /effort high komutunu kullanarak veya yapılandırma dosyasını değiştirerek, düşünce yoğunluğunu manuel olarak en yüksek seviyeye geri döndürebilirler. Bu çözüm teknik olarak mümkündür, ancak aynı zamanda, “en yüksek performans” ın artık varsayılan ayar olmadığı anlamına gelir.

345 dolardan 42,121 dolara, harcanan sadece bütçe değil, aynı zamanda bir varsayım vardır: Üreticinin yaptığı varsayılan yapılandırma değişikliği, kullanıcıların deneyimini geliştirmek içindir.

BlockBeats Resmi Topluluğuna Katılın:

Telegram Abonelik Grubu: https://t.me/theblockbeats

Telegram Sohbet Grubu: https://t.me/BlockBeats_App

Twitter Resmi Hesabı: https://twitter.com/BlockBeatsAsia