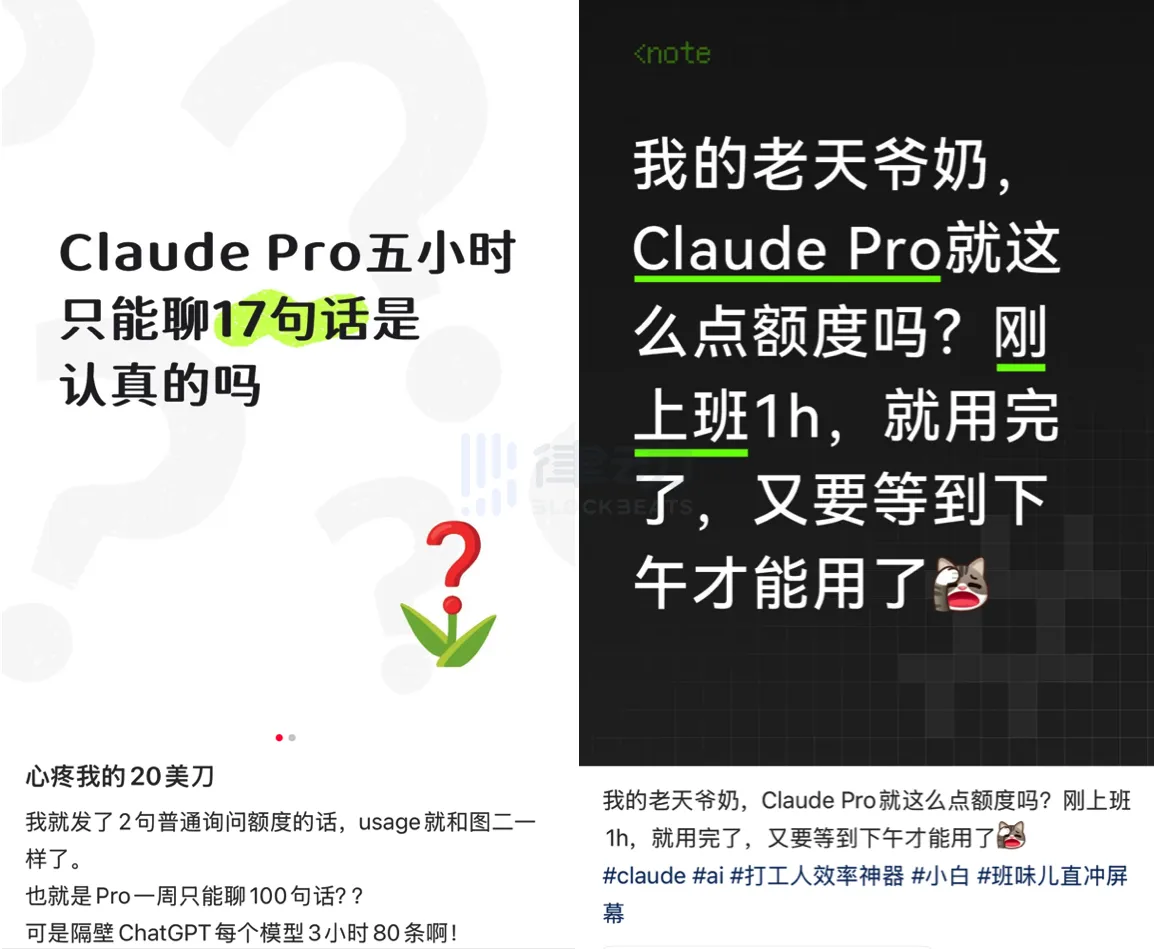

3 sentence hello sınırına takıldı, Claude Code limitin nerede? 28 günlük bir önbellek hatası ve "Daha dikkatli kullan" talimatları içeren resmi yanıt.

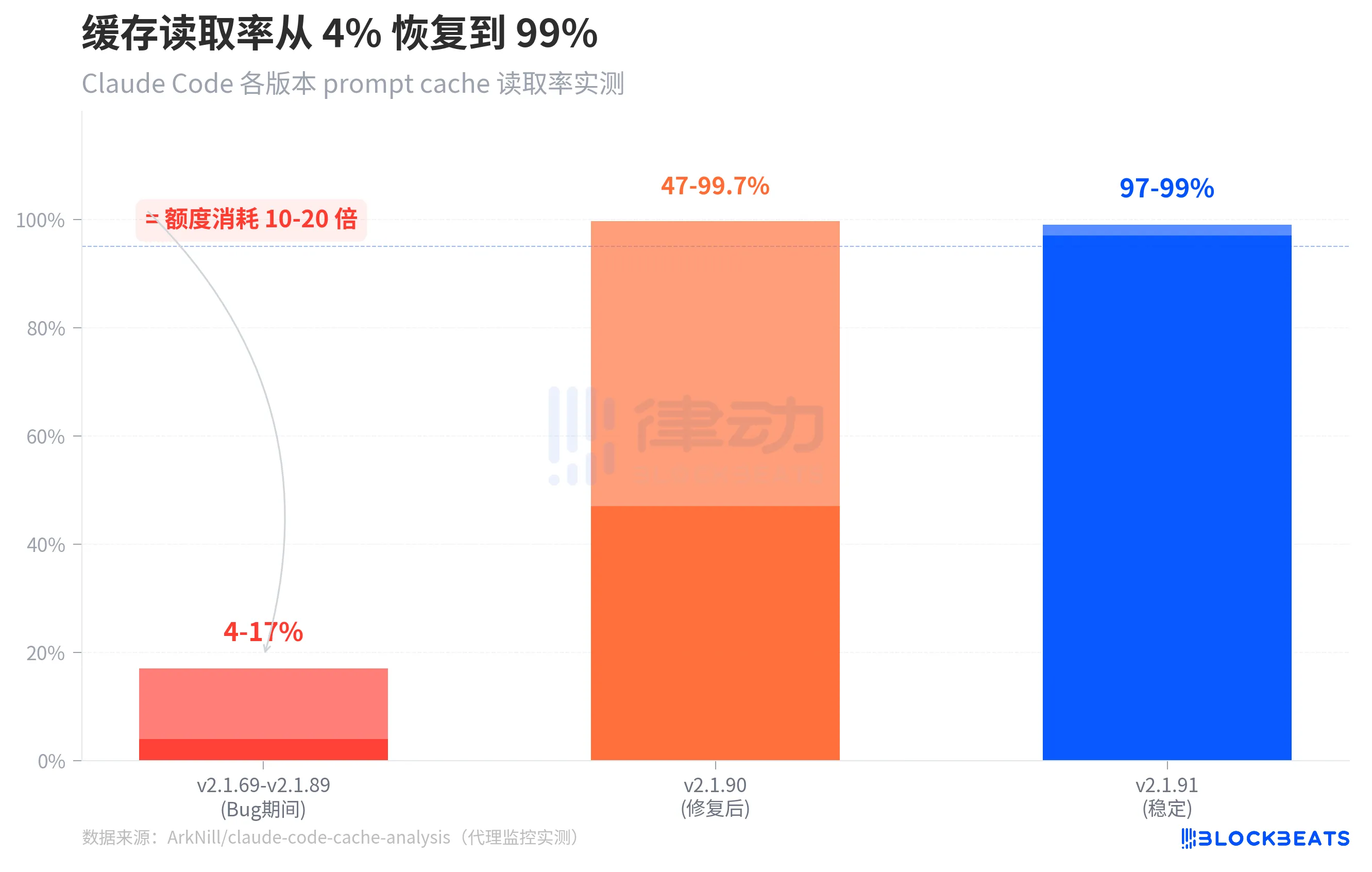

4-17% aralığında. Bu, son bir ay içinde Claude Code'un önbellek okuma oranı. Normal seviye 97-99% aralığındadır.

Bu, bir önceki oturumu geri yüklediğinizde, Claude Code'un önceki işlenmiş bağlamı yeniden kullanmadığı anlamına gelir, her seferinde tüm içeriği baştan işlemesi ve tüketimi normal durumun 10 ila 20 katı olması demektir. Bir konuşmayı sürdürdüğünüzü düşünürken, aslında her seferinde yeni bir, tam fiyatlı konuşma başlatıyorsunuz.

Bu sayı, bağımsız geliştirici ArkNill'in ajan izleme testinden gelmektedir. Şeffaf bir ajan kurarak, Claude Code'un Anthropic API ile her isteği arasındaki her şeyi kaydetti ve en az iki istemci önbellek hatasından kaynaklanan bir API sunucusunun önceden önbelleğe alınmış diyalog önekiyle eşleşemediği tespit edildi ve her turda tam token yeniden oluşturması gerekti.

Yukarıdaki grafik, üç aşamalı önbellek okuma oranını karşılaştırır. v2.1.69 ile v2.1.89 arasında (yani Bug mevcut olduğu dönem), bağımsız versiyonun önbellek okuma oranı yalnızca 4-17% idi. Birincil bir hata düzeltildikten sonra v2.1.90'a ulaşılıklğında, soğuk başlatma önbellek okuma oranı 47-99.7% düzeyine geri döndü. v2.1.91'e ulaşıldığında, stabil çalışan önbellek okuma oranı tekrar 97-99% değerine ulaştı.

Grafiğin dikkat çeken bir detayı, v2.1.90 aralığının oldukça geniş olmasıdır (47% ile 99.7% arasında), çünkü oturumun önceden ısıtılması gerektiği zaman, ilk birkaç dönemde isabet oranı düşüktür, ancak hızlı bir şekilde normal seviyeye döner. Bug sürümünde, bu önceden ısıtma asla gerçekleşmeyecek — önbellek okuma her zaman sistem ipucu kelimelerinin 14.500 tokenine takılı kalacak ve tüm diyalog geçmişi her seferinde tam ücretlendirilecektir.

28 Gün, 20 Sürüm

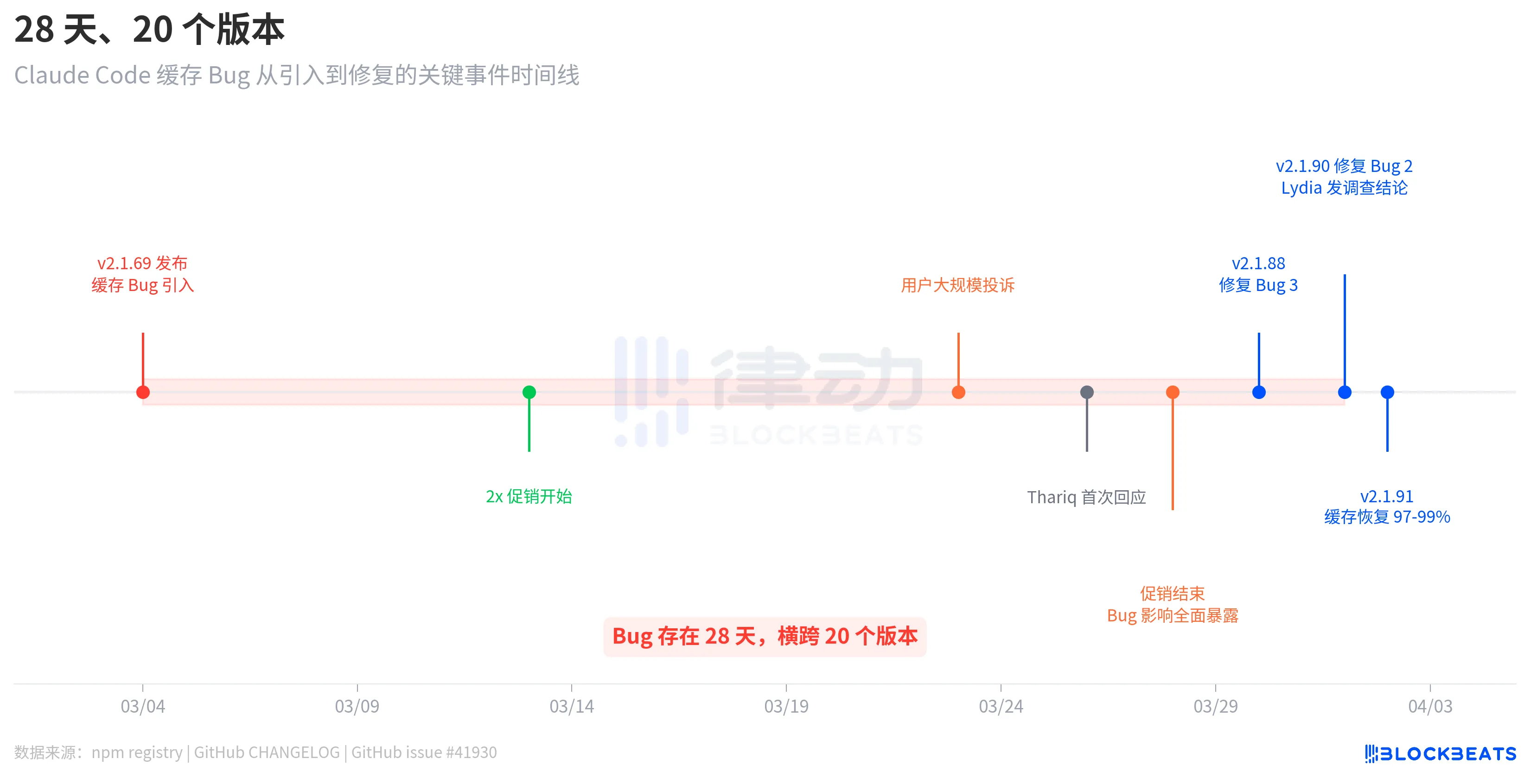

Bu hata, bir güncellemeyle gelen ve bir sonraki güncellemeyle düzeltilen türden bir hata değil. npm deposunun yayın kayıtlarına göre, hataya neden olan v2.1.69 sürümü 4 Mart'ta yayınlandı ve hatayı düzeltmek için yayınlanan v2.1.90 sürümü 1 Nisan'da yayınlandı. 28 gün ve 20 sürüm aralığıyla geçen bir süre var.

Zaman çizgisi ilginç detaylar ortaya koyuyor. 4 Mart'ta hata eklenmesine rağmen, kullanıcılar hemen büyük ölçekte şikayet etmediler. Şikayetler ancak 23 Mart'ta yoğun bir şekilde patlak verdi, arada neredeyse üç hafta vardı. GitHub sorunu #41930'a göre, 13-28 Mart tarihleri arasında Anthropic, iki kat promosyon (dış saatlerde iki katına çıkarma) yapıldı, bu objektif olarak hatanın etkisini örttü. Promosyon sona erdikten sonra, önbellek hatasının tüketimi normal fatura tabanına döndü, kullanıcıların limiti anında "buharlaştı".

Anthropic'in tepkisi pek hızlı olmadı. Kullanıcı şikayetleri patlak verdikten üç gün sonra, yüksek saatlerde (iş günü 5-11am PT), mühendis Thariq Shihipar kişisel X hesabında kısıtlamanın arttığını duyurdu. 30 Mart'ta Anthropic, Reddit'te "kullanıcıların hızla limitlere ulaştığını beklenenden çok daha fazla" olarak kabul etti ve bunun takımın en yüksek öncelikli konu olarak belirlendiğini söyledi. Ancak 1 Nisan'a kadar, ekibin üyesi Lydia Hallie nihai soruşturma sonuçlarını yayınladı.

Genel olarak, Anthropic herhangi bir blog yazısı yayınlamadı, e-posta bildirimi göndermedi, durum sayfasını güncellemedi. Tüm resmi iletişim sadece mühendislerin kişisel sosyal medya gönderileri ve az sayıda Reddit yorumu aracılığıyla gerçekleşti.

Ne Kadar Ödediniz, Ne Kadar Kullanabilirsiniz?

GitHub sorunu #41930, yüzlerce kullanıcı raporunu bir araya getirdi. En aşırı durum, aylık $200 olan bir Max 20x abonesiydi, 5 saatlik kaydırma penceresinin 19 dakika içinde tamamen tükendiğini bildirdi. Max 5x kullanıcısı ($100/aylık) 5 saatlik penceresinin 90 dakika içinde tükendiğini rapor etti. The Letter Two'un bildirdiğine göre, bazı kullanıcılar basit bir "merhaba"nın bile %13'lük oturum kotasını tükettiğini iddia etti. Bir Pro kullanıcısı ($20/aylık) Discord'da, limitinin "her Pazartesi tükenir ve Cumartesi günü sıfırlanır" dedi, 30 gün içinde sadece 12 günü normal şekilde kullanabildiğini belirtti.

ArkNill'in referans testlerine göre, v2.1.89 sürümünde bulunan hatada, Max 20x planının%100 kotasının yaklaşık 70 dakika içinde tükeneceği ortaya çıktı. Ayrıca, tek seferlik --resume işleminin 500K jetonlu bir bağlam oturumunun kotasına maliyeti yaklaşık $0.15 olduğunu hesapladı, çünkü sistem bütün bağlamı tamamen yeniden oynatır.

「Yanlış Tutuyorsun」

Lydia Hallie'nin yaptığı araştırma, iki önemli noktayı doğruladı: birincisi, yoğun saatlerde kota gerçekten sıkılaştı ve ikincisi, 1 milyon tokenlik bağlamın tüketiminin arttığıydı. Lydia, ekip tarafından bazı hataların düzeltildiğini ancak "hiçbir hata'nın yanlış ücretlendirmeye yol açmadığını" vurguladı.

Sonrasında dört tasarruf önerisi verdi:

1. Opus yerine Sonnet 4.6 kullanın (Opus'un tüketimi yaklaşık iki katıdır);

2. Derinlemesine düşünme gerektirmeyen durumlarda düşünme yoğunluğunu azaltın veya genişletilmiş düşünmeyi kapatın;

3. Bir saatten fazla boşta duran uzun oturumları geri yüklemeyin, yeni bir oturum başlatın;

4. CLAUDE_CODE_AUTO_COMPACT_WINDOW=200000 çevresel değişkenini ayarlayarak bağlam penceresi boyutunu sınırlandırın.

Herhangi bir kota sıfırlama veya telafi söz konusu değildi.

AI podcast sunucusu Alex Volkov, bu yanıtı "Yanlış Tutuyorsun" olarak özetledi, Anthropic'in kendi kendine 1 milyon tokenlik bir bağlamı varsayılan olarak belirlediğini, Opus'u amiral gemisi model olarak tanıttığını, genişletilmiş düşünmeyi satış noktası olarak sunduğunu ancak şimdi ücretli kullanıcılara bu özellikleri kullanmamalarını önerdiğini belirtti.

"Hiçbir hata" ifadesi, Claude Code'un kendi güncelleme geçmişi ile çelişmektedir. Lydia'nın yanıtını yayınladığı günün bir gün öncesinde, v2.1.90, v2.1.69'dan beri var olan bir önbellek geri dönüş hatasını düzeltti: Oturumu --resume kullanarak geri yüklerken, önbelleği vurması gereken istekler tam bir önbellek hatası tetikler ve tam ücretlendirme yapar. Lydia'nın yanıtında, bu onaylanmış ücretlendirme anormalliğine değinilmemiştir.

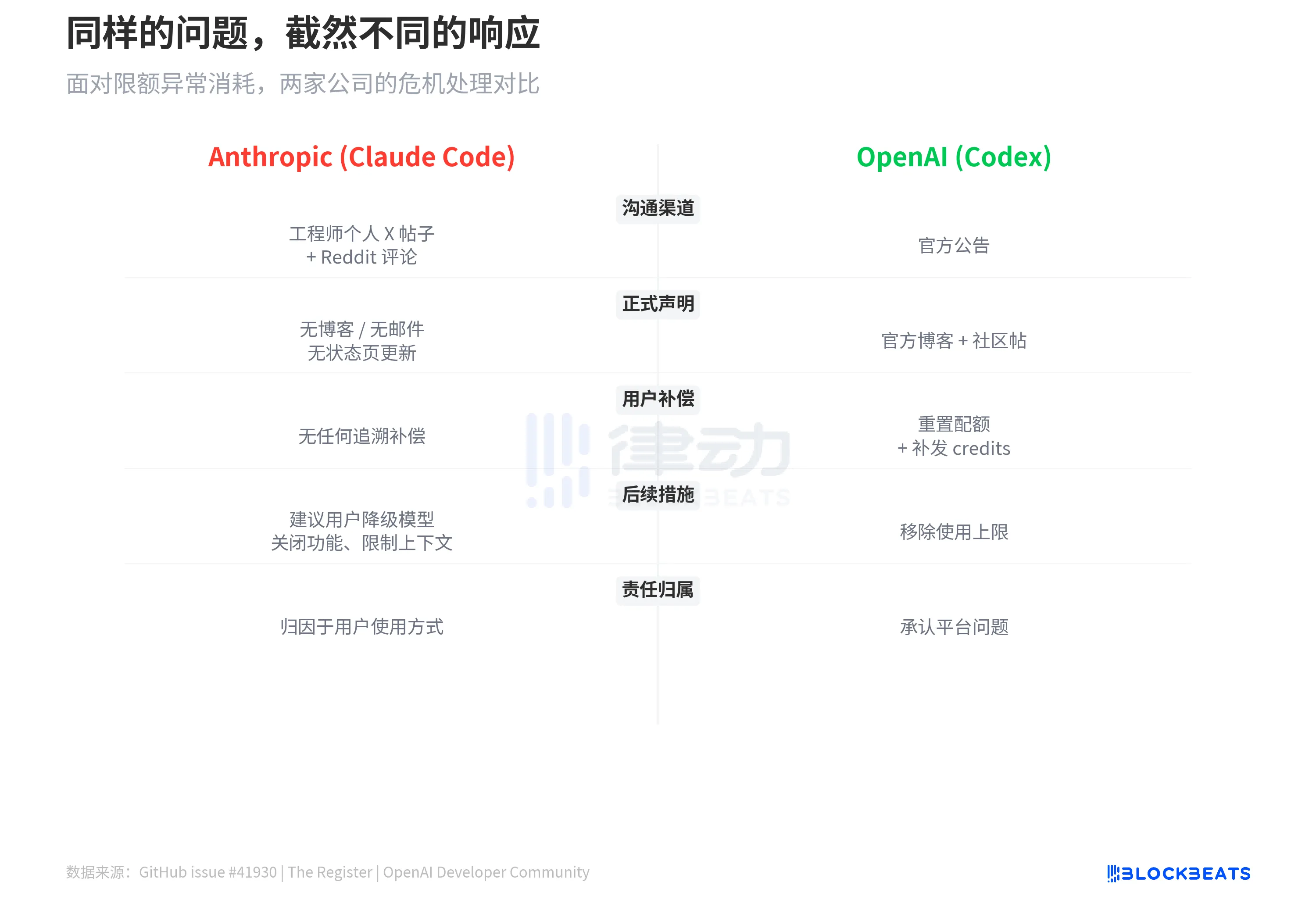

Kıyaslama olarak, OpenAI'nin Codex'i de benzer kota anormalli tüketim sorunuyla karşılaştı. OpenAI'nin uygulaması, kullanıcı kotasını sıfırlamak, kredileri geri ödemek ve Mart ayında Codex'in kullanım limitini kaldırma planlarını duyurmaktı. Anthropic'in uygulaması, kullanıcıların modeli düşürmesini, özellikleri kapatmasını, bağlamı sınırlandırmasını ve sorumluluğu kullanıcının tutumuna yüklemesini içeriyordu.

Anthropic, en güçlü model + en geniş bağlam + en yüksek mantık kapasitesi" aboneliği satmaktadır ve aylık 20 ila 200 dolar arasında ücret almaktadır. 28 gün süren bir önbellek hatası, ödeme yapan kullanıcıların kontenjanının 10-20 kat daha hızlı azalmasına neden oldu ve resmi yanıt, daha dikkatli kullanmanızı öneriyordu.

BlockBeats Resmi Topluluğuna Katılın:

Telegram Abonelik Grubu: https://t.me/theblockbeats

Telegram Sohbet Grubu: https://t.me/BlockBeats_App

Twitter Resmi Hesabı: https://twitter.com/BlockBeatsAsia