Claude, 48 saatlik yasağın ardından App Store'un zirvesine çıktı.

Cumartesi sabahı, Ultraman X üzerinde iç bir e-posta ekran görüntüsünü paylaştı.

E-posta, Perşembe akşamı OpenAI çalışanlarına yazdığı, şirketin Pentagon ile görüştüğünü ve "durumu hafifletmeye" yardımcı olmayı umduğunu belirten bir e-postaydı. Bu e-postayı, birkaç açıklama ekleyerek paylaştı; genel olarak, son günlerde neler olduğunu açıklamak istiyordu.

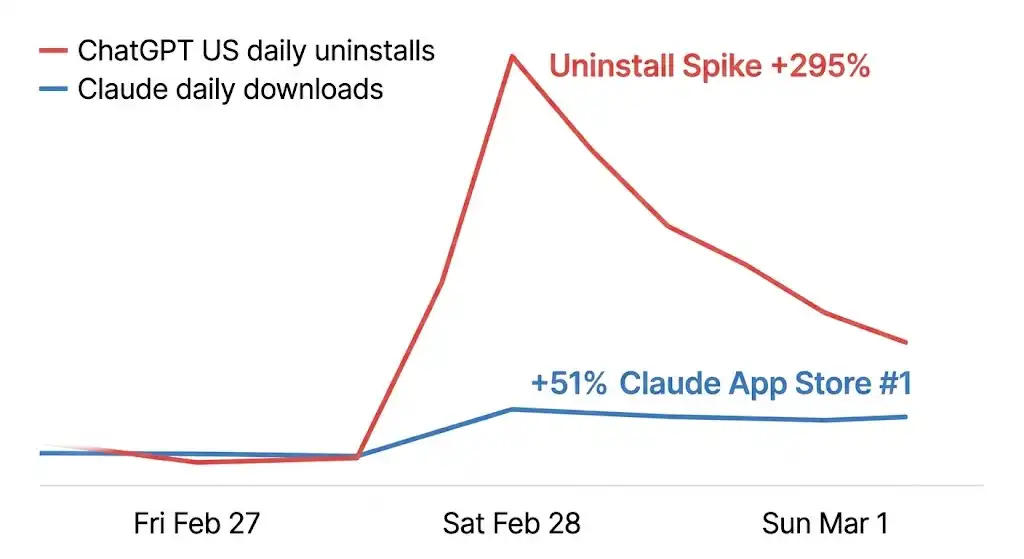

Bu tweet'i attığında, Claude hali hazırda ABD App Store'un ücretsiz listesinde bir numaraya yükselmişti. Bir gün önce, ChatGPT hala o pozisyonda idi.

Sensor Tower'ın verileri, sonrasında yaşanan olayları kaydetti: Cumartesi günü, ABD'de ChatGPT'nin kaldırılma sayısı günlük bazda %295 arttı, 1 yıldızlı yorumlar %775 arttı. Aynı anda, Claude'ün indirme sayısı günlük bazda %51 arttı. Reddit'de "ChatGPT'yi İptal Et" dalgası baş gösterdi, kullanıcılar aboneliklerini iptal etme ekran görüntüleri paylaştı, bazıları yorumlarda "hayatımın en hızlı yüklemesi" yazdı. QuitGPT.org adında bir web sitesi yayına girdi, 1.5 milyon kişinin harekete geçtiğini iddia etti.

Pazartesi günü, gelen kullanıcı sayısı o kadar fazlaydı ki, Claude büyük çapta çöktü. Federal hükümet tarafından "tedarik zinciri güvenlik riski" olarak belirlenen şirket, kullanıcıların akınına uğradığı için sunucular baskı altında kaldı.

Hassas Ürün Karşılığı

Kaldırma dalgası yayıldığı gün, Anthropic hafıza taşıma aracını tanıttı.

Fonksiyon kendisi karmaşık değildi. Kullanıcılar, ChatGPT'ye bir ipucu kopyalayıp yapıştırarak tüm depolanan hafızayı ve tercihleri çıkarmasını sağlar, ardından bu çıktıyı Claude'e yapıştırır, Claude, ChatGPT'yi terk ettiğiniz noktadan devam eder. Resmi web sitesinde sadece şu cümle vardı: "sıfırdan başlamadan Claude'e geçin".

Bu aracın zamanlaması, en önemli özelliği oldu.

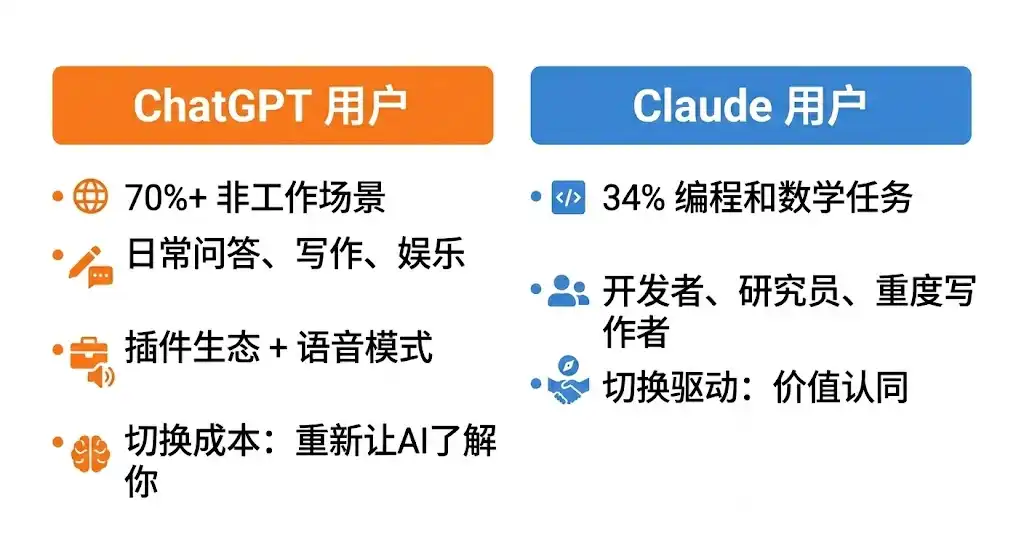

OpenAI'in kendi verileri, 2025'e kadar ChatGPT kullanıcılarının %70'den fazlasının çalışma dışı senaryolarda olduğunu gösteriyor; günlük soru-cevap, yazma, eğlence, bilgi arama hepsi içinde. Bu, birçok kişinin karşılaştığı ilk yapay zeka, geniş eklenti ekosistemi, Ses Modu ve derin entegre üçüncü taraf uygulamalarıyla günlük yaşama yerleşmiş durumda. Bu kullanıcıların geçiş maliyeti sadece "yeni bir uygulama indirmek" değil, tanımadığınız bir yapay zekaya kim olduğunuzu sıfırdan yeniden tanıtmak demek. Hafıza biriktirmek, önceki en güçlü nedendi.

Anthropic'ın kendi araştırma verileri, Claude'un kullanım senaryosunun büyük ölçüde yoğunlaştığını gösteriyor. Programlama ve matematik görevleri %34'ü oluşturuyor, tek başına en büyük kategoridir, eğitim ve bilimsel araştırma ise geçen yılın en hızlı büyüyen alanıdır. Temel kullanıcılar geliştiriciler, araştırmacılar ve yoğun içerik üreticileridir ve bu grup daha rasyonel olup, bir değerlendirme sonucunda aracı değiştirmeye daha yatkındır, geçiş maliyeti yeterince düşük olduğu sürece.

Hafıza Taşıma Aracı bu maliyeti en aza indirirken. Aynı zamanda, Anthropic, hafıza özelliğini ücretsiz kullanıcılara tamamen açacağını duyurdu, bu özellik daha önce ücretli özel bir özellikti.

Ancak bu yeni gelen kullanıcı dalgasının önemli bir kısmı aslında ilk başta hedeflenen Claude kullanıcıları değil.

Sosyal medyadaki geri bildirimlere bakıldığında, ChatGPT'den yoğun bir şekilde geçiş yapan normal kullanıcıların, Claude'u ilk kullandıklarındaki tepkilerinin genellikle "Farklı" olduğu görülmekte. Kimi kişiler Claude'un yanıtlarının daha derin olduğunu düşünüp aktif olarak geri itirazda bulunurken, her şeyi iyi şekilde söylemek yerine. Bazıları yazma konusunda daha temiz bulurken, ancak resim oluşturmaz, Voice Mode gibi etkileşimli deneyim sunmaz.

Bazıları başlangıçta "daha itaatkar bir ChatGPT alternatifi arıyordu" ancak Claude'un daha güçlü bir kişiliğe sahip olduğunu, uyum sağlamak için zaman gerektiğini fark etti. TechRadar'ın bir göç rehberi günler içinde büyük ölçüde paylaşıldı; başlığı "Keşke baştan biri bana bunları söyleseydi" olan makalenin temel mesajı şuydu: Claude ve ChatGPT'nin kullanım mantığı temelde farklı, birincisi daha çok bir tavır sahibi iş ortağı gibi, ikincisi ise daha çok evrensel bir asistan gibidir.

Bu farklılık aslında iki ürünün kendi pozisyonlarıydı; ancak bu olayın beklenmedik bir şekilde artan şekilde büyümesine neden oldu. Kullanıcılar ahlaki pozisyon nedeniyle Claude'a yönlendirildi ve sonra beklentilerinden farklı bir ürün buldular, daha eleştirel, sınırları olan bir YZ. Bu aslında bir terk nedeni olabilirdi, ancak bu özel zaman noktasında, aslında kalmalarının nedeni haline geldi: Bir şirketin pozisyonuna inanıyorsanız, ürününün mantığını kabul etmek daha kolay olur.

Piyasaya sürülmesinden birkaç gün sonra, Anthropic verilerini açıkladı: Ücretsiz etkin kullanıcılar Ocak ayına göre %60'ın üzerinde büyüdü, günlük yeni kayıt sayısı dört kat arttı. Claude'un ziyaretçi trafiği aşırı yüklendiği için bazı binlerce kullanıcı giriş yapamadı ve birkaç saat içinde sorun giderildi.

Sözleşmedeki Üç Kelime: OpenAI Ne Dedi, Ne Yaptı

Anthropic, AI modelini ABD askeri gizli ağına dağıtan ilk şirket olup, işbirliği Palantir aracılığıyla gerçekleştirildi ve sözleşme değeri yaklaşık 200 milyon dolar. Ancak son birkaç ay içinde, taraflar arasındaki ilişki sürekli olarak kötüleşti. Tartışmanın merkezinde bir madde var: Pentagon, AI modelinin "tüm yasal kullanımlar" için açık olmasını talep etti, herhangi bir koşul eklenmemesini istedi. Ancak Anthropic, iki istisna belirtmeyi ısrar etti: ABD vatandaşlarının geniş çapta izlenmemesi ve tamamen otonom silah sistemleri için kullanılmaması.

20 Şubat civarında, Anthropic'in bir yöneticisi, Ocak ayında ABD'nin Maduro'yu tutuklama operasyonunda Claude'ün kullanımı hakkında Palantir ile işbirliği yapan birine soru sormuş, ordunun bundan şiddetle rahatsız olduğu bildirildi. Perşembe günü, Pentagon son şansı verdi ve Dario Amodei'nin aynı gün saat 5'ten önce cevap vermesini şart koştu.

Amodei, son teslim tarihinden önce bir açıklama yaparak, şirketin mevcut şartları kabul edemeyeceğini belirtti, "Askeri amaçlara karşı olmamızdan değil, nadir durumlarda yapay zekanın demokratik değerleri korumak yerine tehlikeye yol açabileceğine inandığımız için" dedi. Trump hemen federal kurumların altı ay içinde tüm Anthropic ürünlerini kullanmayı bırakacağını duyurdu, Hegseth bunu "tedarik zinciri güvenlik riski" olarak listeledi, bu etiket genellikle yabancı rakip şirketler için kullanılır. Sözleşme bu şekilde sona erdi.

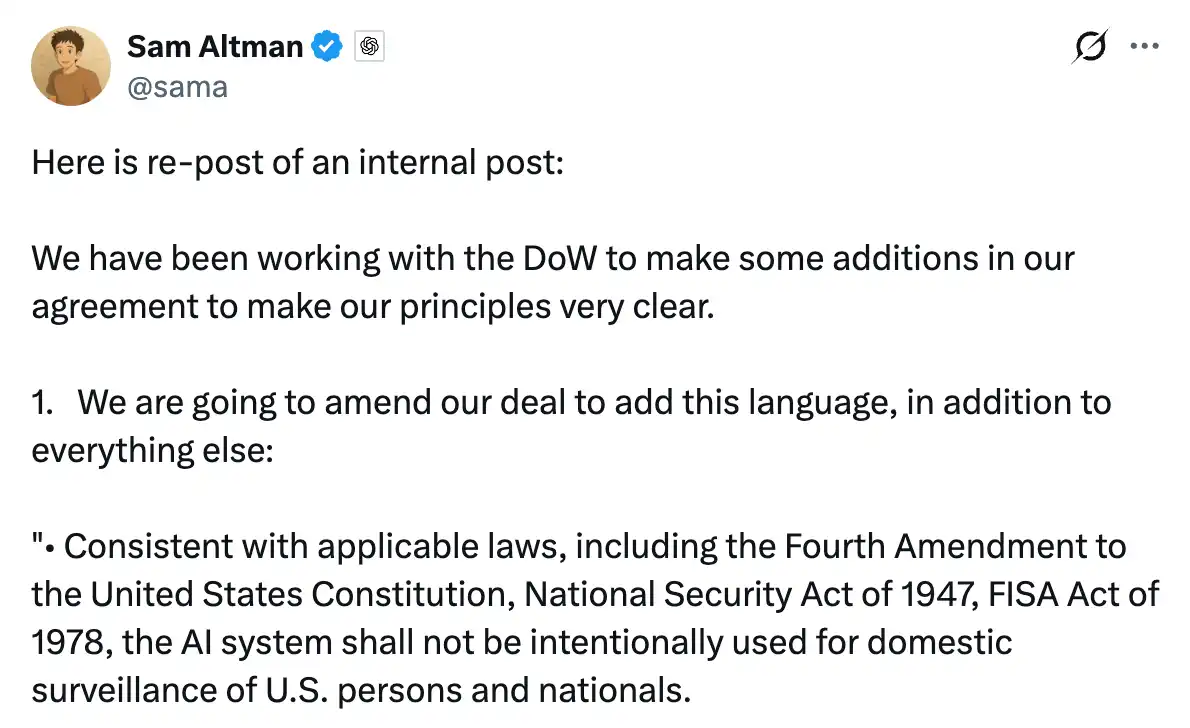

Boşalan pozisyon hızla doldu. Aynı günün ilerleyen saatlerinde, OpenAI ve Pentagon arasında anlaşmaya varıldığı açıklandı. Ötman, Perşembe günkü iç yazısında, pozisyonunu net bir şekilde belirtti ve bunun "tüm sektörün sorunu olduğunu" yazdı, OpenAI ve Anthropic'in aynı "kırmızı çizgiye" sahip olduğunu belirtti: büyük ölçekli gözetimi ve otonom silahlara karşı olmak. Cuma günü anlaşma sağlandı ve modelin gizli askeri ağlara, sadece bulutta çalışmasına izin verilecek şekilde ve mühendislerin denetiminde, dağıtılacağını ve aynı kısıtlamaların sözleşmede belirtildiğini belirtildi.

Ardından, Ötman X'te bir soru cevap oturumu düzenledi ve saatlerce soruları yanıtladı. Birisi ona sordu: Pentagon neden OpenAI'ı kabul etti ama Anthropic'i yasakladı? Onun cevabı şuydu: "Anthropic, sözleşmedeki belirli yasak maddelere odaklanmış gibi görünüyor, yasal referansları alıntı yapmaktansa, biz yasal referanslardan memnunuz."

Bu ifade metodoloji farklılıklarını anlatıyor, ancak asıl tartışma konusunu açıyor.

Anthropic'in çöküşünde kilit nokta, Pentagon'un eklediği o ifadedir: AI sistemi "tüm yasal amaçlar" için kullanılabilir, yani tüm yasal amaçlar için. Anthropic'in reddetme nedeni, bu ifadenin ulusal güvenlik bağlamında sabit bir sınır oluşturmamasıdır. Mevcut yasalar birçok açıdan yapay zekanın yeteneklerine ayak uyduramamaktadır, "yasal" kapsamı hükümetin kendi yorumuyla belirlenecektir. OpenAI bu ifadeyi imzaladı, aynı korumanın sözleşmede belirtildiğini iddia ederek.

Ardından hukuk uzmanları, OpenAI'ın açıkladığı sözleşme koşullarını incelediler ve iki belirli ifade sorununu belirlediler.

Gizlilik Şartı şöyle diyor: sistem, Amerikan vatandaşlarının özel bilgilerinin "kısıtlanmamış" izlenmesi için kullanılamaz. Demokrasi ve Teknoloji Merkezi Politika Başkan Yardımcısı Samir Jain, buradaki ifadenin "kısıtlanmış" izleme versiyonunun izin verildiği anlamına geldiğini belirtti. Mevcut yasal çerçeve içinde, hükümet tamamen veri simsarıdan yasal olarak vatandaşın konum kayıtlarını, gezinme geçmişini ve finansal verilerini satın alabilir ve yapay zekanın bu verileri analiz etmesine olanak tanıyabilir; bu, teknik olarak "yasadışı izleme" oluşturmaz. Amodei daha sonra CBS'e verdiği röportajda tam da bu örneği verdi.

Silahlarla ilgili şart şöyle diyor: sistem, "yasal, düzenleyici veya kurum politikasının insan kontrolünü gerektirdiği durumlarda" otonom silahlar için kullanılamaz. Bu kısıtlama ifadesi, kısıtlamanın yalnızca diğer düzenlemelerin zaten insan kontrolünü gerektirdiği durumlarda geçerli olacağı anlamına gelir, kısıtlama tamamen mevcut politikalara dayanır. Pentagon, kendi iç politikasını istediği zaman değiştirme hakkına sahiptir. Hukukçu Charles Bullock, X'te, sözleşmedeki silahlarla ilgili şartın DoD Talimatı 3000.09'a dayandığını belirtti; bu talimat komutanların "uygun insan takdirini" korumasını şart koşar ve bu "uygun derece" esnek bir şekilde yorumlanabilen bir standarttır.

OpenAI'ın bu eleştirilere yanıtı şudur: model yalnızca bulutta çalıştırılabilir, bu da doğrudan silah sistemine entegre edilme olasılığını ortadan kaldırır. Sözleşmede ayrıca belirli yasal dayanaklar açıkça belirtilmiştir; bu, metin tabanlı yasaklama şartlarından daha kısılayıcıdır çünkü yasalar önceden test edilmiş bir çerçevedir. Atom, kendi ifadesiyle, "Eğer gelecekte bu savaşı yapmamız gerekiyorsa, yapacağız; ancak açıkça bazı risklerle karşılaşacağız," dedi.

Bu, bir şirketin prensiplerden taviz vermesi ve diğerinin prensiplerine bağlı kalması sorunu değildir; bu, temelde farklı güvenlik felsefeleri açısından iki farklı türdür. OpenAI'ın çizgisi şudur: Yasadışı olanı yapmam. Anthropic'ın çizgisi şudur: Yasayla henüz yasaklanmamış olabilir, ancak yapmam gerektiğini düşündüğüm bir şeyi yapmam.

Bu anlaşmazlık, OpenAI içinde de çatlaklar bıraktı. Geçen hafta, birkaç OpenAI çalışanı, Anthropic'in pozisyonunu destekleyen bir açık mektuba imza attı, onu tedarik zinciri riski olarak belirtmeye karşı çıktı. Aligned Araştırmacısı Leo Gao, şirketin sözleşmenin yeterli korumayı sağlayıp sağlamadığını açıkça sorguladı. OpenAI'ın San Francisco ofisinin dışındaki kaldırımlarda eleştirel tebeşir yazıları görüldü. Anthropic'in ofisinin dışında ise destekleyici mesajlar yer aldı. Atom'un uzun süren X soru cevap oturumu, büyük ölçüde, aslen Anthropic yanında duran içerideki insanlara yönelikti.

Aynı Anlatının İki Sonucu

Anthropic, yıllardır kendini güvenlik misyonunu "medeniyet düzeyindeki riskleri önleme" olarak çerçevelemektedir, ileri AI'nin potansiyel tehditini nükleer silahlarla eşdeğer görmektedir ve kendisini bu savunma hattındaki bir bekçi olarak konumlandırmaktadır. Bu hikaye, markasının temelidir ve sermaye piyasasında güven kazanma yoludur.

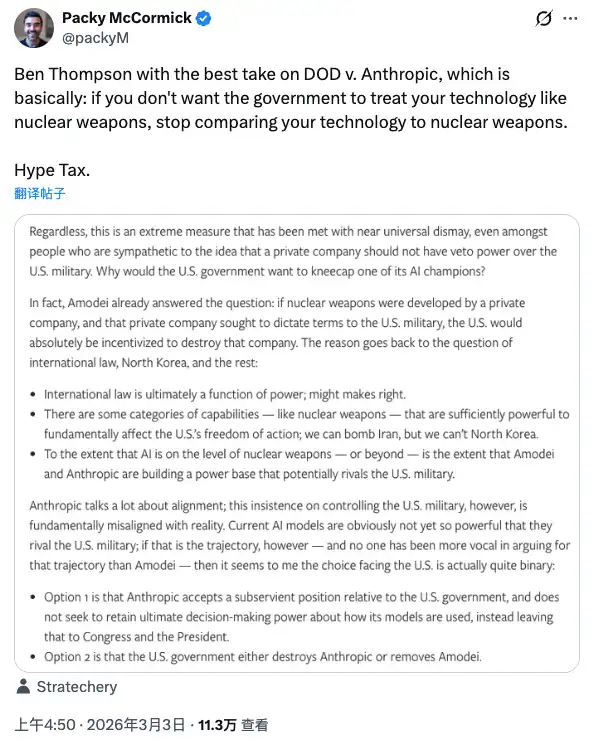

Tech yorumcusu Packy McCormick, bu olayın olgunlaşma sürecinde, Ben Thompson'ın bir kavramına atıfta bulundu: Hype Vergisi. Bu, kendinizi etkileyi oluşturmak için aşırı anlatı kullanırsanız, o zaman bu anlatı gerçek güçle karşılaştığında bedel ödemek zorunda kalırsınız. AI teknolojisini nükleer silaha benzetirseniz, hükümet de sizi nükleer silaha nasıl davranıyorsa öyle davranır.

Anthropic, bu anlatı için bir bedel ödedi: Bir sözleşme kaybı, güvenlik riski olarak listelendi, başkan tarafından doğrudan adı geçirildi ve tüm ürünlerinin federal sistemden altı ay içinde kaldırılması istendi.

Ancak aynı haftasonu, aynı anlatı başka bir boyutta tamamen zıt bir etki yarattı.

Normal kullanıcılar gördükleri şey, bir sözleşme detayı değil, hukuk açıklaması değil, güvenlik felsefesi tartışması değil. Gördükleri şey şuydu: Bir şirket 'hayır' dedi, hükümet onları kovdu. Diğer bir şirket 'evet' dedi, sözleşmeyi aldı. Kendi değerlendirme çerçevelerini kullanarak bir seçim yaptılar, %295 uygulamanın kaldırılması, App Store'da birinci sıra, çöken sunucular.

Bu, AI endüstrisinde nadir görülen bir tüketici kitlesel ahlaki duruştur.

Anthropic, bu konuda PR bütçesinden bir kuruş harcamadı. Amodei'nin açıklaması ölçülüydü, kullanıcı desteğine çağrıda bulunmadı, OpenAI'ı adlandırmadı, kendisini bir şehit olarak yansıtmadı. Ama sonuçlar ortada.

Burada dikkate değer bir detay var: Kullanıcıların Claude'e akın etmesine neden olan olay, temelde OpenAI'ın ticari olarak tamamen mantıklı bir şekilde hareket ettiği, rakip şirketin yasaklandığı, sözleşmenin belirsiz kaldığı bir sırada anlaşmayı imzalaması ve aynı koruma şartlarını görüştüğünü iddia etmesi oldu. Öte yandan, Ultraman, bu adımı kısmen durumu yatıştırmak, Anthropic'e daha fazla zarar gelmesini önlemek için attığını açıkça belirtti.

Her ne olursa olsun, sonuçta OpenAI bir sözleşme aldı, Anthropic'in kullanıcı tabanı büyüdü. Her iki tarafın da maliyeti ve kazancı oldu, sadece ölçüm birimleri farklıydı.

Burada dikkate değer bir başka nokta var.

Anthropic'in Pentagon sözleşmesini kaybetmesi, yaklaşık 200 milyon dolar değerindeydi.

Anthropic'in mevcut yıllık geliri 14 milyar dolar. 2026 yılına kadar 260 milyar dolara ulaşmayı hedefliyor.

Anthropic geçen ay sadece 300 milyar dolarlık bir E turu finansmanını tamamladı ve değerlemesi 3800 milyar dolar oldu.

Bu iş şu anda zor değil. Ancak cevaplanması gereken başka bir sorun daha var: Askeri kararlar için yapay zeka gerçekten büyük ölçekte kullanıldığında, sözleşmelere yazılan "teknoloji duvarı" ve görevlendirilen mühendisler, OpenAI'nınki olsun, Anthropic'in talep ettiği de olsun, gerçekten işe yarayabilecek mi?

Bu sorun herhangi bir açık sözlü sözleşmede yer almıyor.

BlockBeats Resmi Topluluğuna Katılın:

Telegram Abonelik Grubu: https://t.me/theblockbeats

Telegram Sohbet Grubu: https://t.me/BlockBeats_App

Twitter Resmi Hesabı: https://twitter.com/BlockBeatsAsia