Sam Altman'ın Yirmi Dört Saati: Pentagon İki Kez "Hayır" Dedi, Ama Sadece Bir Kişiye Ciddiye Aldı

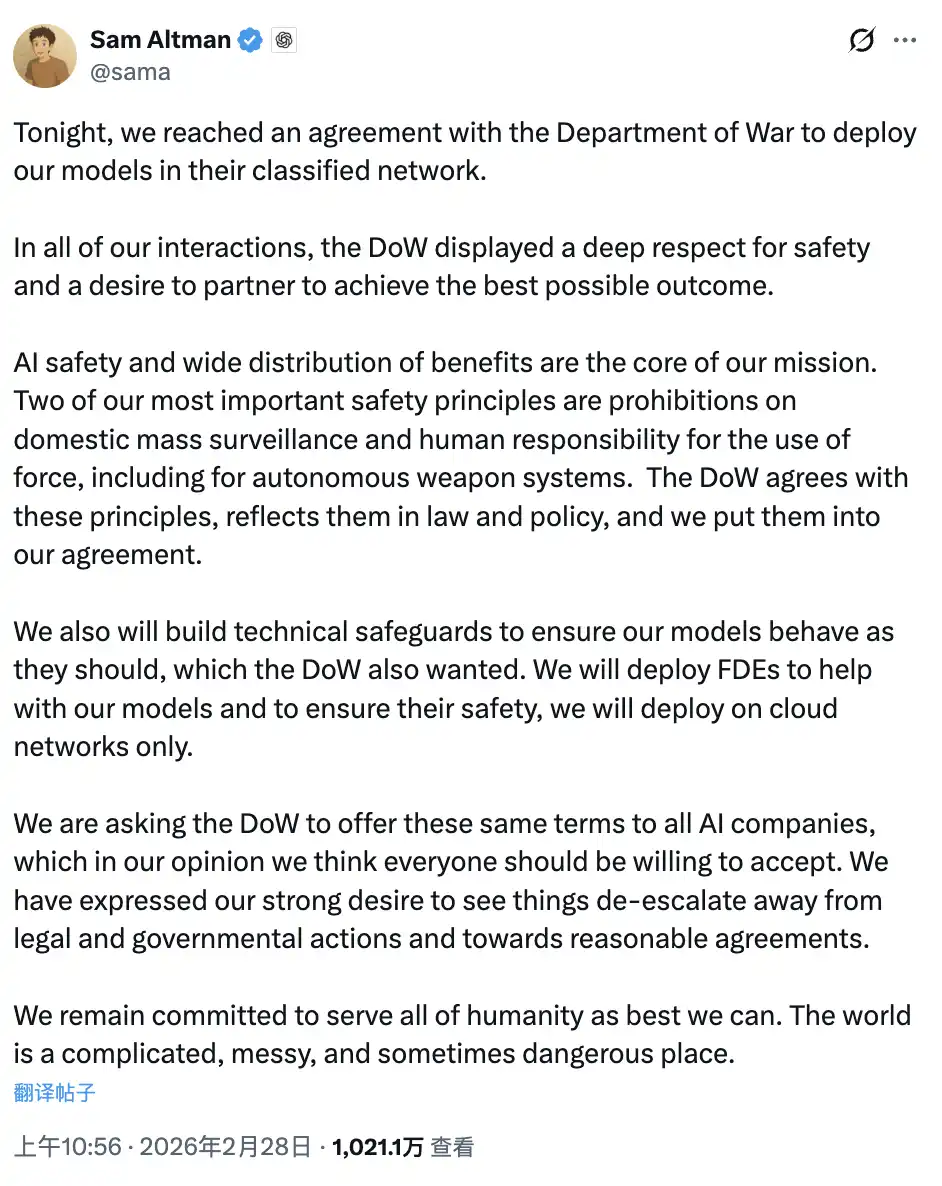

28 Şubat tarihinde, Pekin saatiyle sabah saatlerinde, Sam Altman bir tweet attı: "Bu akşam, ABD Kara Kuvvetleri ile anlaşmaya vardık ve modelimizi onların gizli ağlarına dağıtacağız."

Gerçekleştirilen anlaşmaya yaklaşık on iki saat geriye gidildiğinde, Pekin saatiyle 27 Şubat akşamına gelinir. Yine o, CNBC'nin Squawk Box programının kamerası karşısında sakin bir şekilde şunları söyledi: "Anthropic için, aramızda birçok anlaşmazlık olsa da, bu şirkete genel olarak güveniyorum. Gerçekten güvenliklerini önemsediklerine inanıyorum." Ayrıca şunları da söyledi: "Pentagon'un bu şirketleri tehdit etmek için Savunma Üretim Yasasını kullanması gerektiğini düşünmüyorum."

On iki saatten az bir süre içinde, aynı ağızdan iki farklı ifade. Arada neler yaşandığını ayrıntılı şekilde açıklamaya değer.

Benzer İki Anlaşma Maddesi, Farklı İki Sonuç

Öncelikle, iki anlaşmanın temel içeriğini yan yana koyalım.

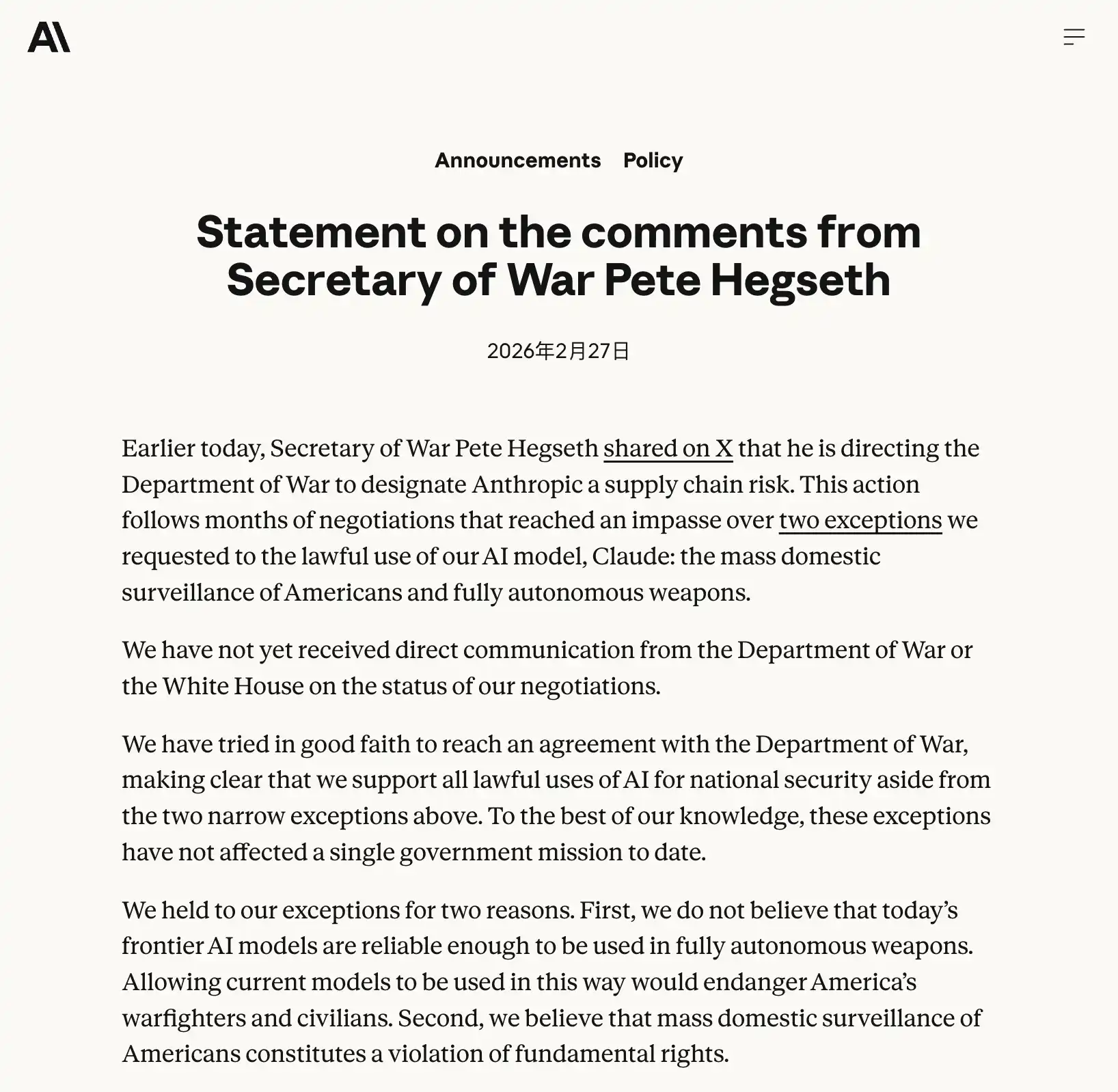

Anthropic'in talepleri: Claude'ün geniş çapta ABD vatandaşlarını izlemek veya insan müdahalesi olmadan otonom silah sistemlerinde kullanılmaması.

Altman, anlaşmayı duyurduğu tweetinde, aynı prensipleri şu şekilde aktardı: "Uzun süredir, yapay zekanın geniş çapta izlemede veya otonom ölümcül silahlarda kullanılmaması gerektiğine inanıyoruz, insanlar yüksek riskli otomatik kararlar alırken her zaman mevcut olmalıdır." Ayrıca şunları yazdı: "Pentagon, bu prensipleri kabul etti ve bunları yasalara ve politikalara yansıtacak, biz de onları anlaşmaya dahil ettik."

Metinler neredeyse tamamen aynı.

Bir şirket yasaklandı, "tedarik zinciri riski" olarak listelendi, Trump tarafından Truth Social'da "radikal solcu uyanış şirketi" olarak hakaretlere maruz kaldı. Diğer bir şirket ise anlaşma aldı, Pentagon'un gizli ağına girdi, Sam Altman tweetinde "anlaşmaya varıldı" sözcüğünü kullandı – sakin, iş gibi, adeta sıradan bir B2B işlemi tamamlandı.

Cevaplanması gereken soru, benzer maddelerin neden tamamen farklı sonuçlar doğurduğudur.

Cevap, maddelerde değil, maddelerin arkasındaki mantıkta yatmaktadır.

Önceden belirtilmesi gereken bir arka plan gerçeği var: Anthropic, bu dört şirketin (diğer üçü OpenAI, Google, xAI) arasında Pentagon'un gizli ağına yapay zekayı erişime izin verilen tek şirkettir. OpenAI'ın mevcut sözleşmesi, yalnızca gayri resmi günlük iş ortamlarını kapsamaktaydı. Bu müzakere, temelde OpenAI'ın gizli ağa erişmek istemesi ve Pentagon'un sunulan giriş koşulu olan o tartışmalı "her yasal amaçla" maddesiydi. Anthropic içerideydi ama Pentagon, içeri girdiğinde koyduğu güvenlik kilidini söktürmeyi istedi.

Pentagon’un Umurunda Değil Ne Yazıldığı, Kimin Ne Dediğidir

Bu konuyu anlamak, Anthropic’in Dario Amodei’nin açık mektubunda aslında ne dediğini anlamayı gerektirir.

Şunları yazdı: "Anthropic, askeri kararların özel şirketler değil Pentagon tarafından alındığını anlar. Biz hiçbir zaman belirli bir askeri eyleme itiraz etmedik ve teknolojimizin kullanımını geçici olarak kısıtlamaya çalışmadık."

Sonra şöyle devam etti: "Ancak çok az sayıda durumda, yapay zekanın demokratik değerleri savunmak yerine tahrip edebileceğine inanıyoruz. Tehdit bizi konumumuzdan değiştirmeyecek: Vicdanımız rahat, isteklerini kabul edemeyiz."

Bu ifadeyi sözleşme diline çevirmek ne anlama gelir? Anthropic, ilkelerin sözleşme maddelerinde net bir şekilde belirtilmesini ve tarafların bu ilkelere sıkı sıkıya bağlı kalmasını talep eder. Karşı taraf ihlal ederse, hizmeti durdurma hakkına sahiptir.

Pentagon ne duydu? Bir özel şirket, hükümetin ordusuna şunu söylüyor: Bazı durumlarda, emirlerinizi uygulamamı, sınırları ben belirlerim.

Bu herhangi bir ordu için kabul edilemez bir durumdur. Gerçekten geniş kapsamlı izleme yapmak istedikleri için değil, ancak "kimin karar verme yetkisine sahip olduğu" meselesi, askeri komuta yapısındaki en hassas sinir olgusudur. Askeri tedarik yöneticisi Jerry McGinn net bir şekilde belirtmiştir: Genellikle askeri yükleniciler, ürünlerinin nasıl kullanılabileceği veya kullanılamayacağı konusunda Pentagon'a söyleme hakkına sahip değiller. Aksi takdirde her sözleşme, belirli kullanım senaryoları hakkında pazarlık yapılmalıdır, bu gerçekçi değil."

OpenAI tamamen farklı bir yanıt verdi.

Altman, çalışanlara bir notta OpenAI'ın Pentagon'a, AI modellerinin ve gerçek dünya kullanımı arasına yerleşecek, teknik kontrol, politika çerçevesi ve insan denetiminden oluşan çok katmanlı bir koruma sistemi olan "güvenlik yığını"nı kurmayı önerdiğini belirtti. OpenAI aynı zamanda, güvenlik lisansına sahip araştırmacıları gizli ağa gönderebileceğini ve AI davranışlarını sürekli olarak izleyebileceğini, modelin yalnızca bulutta dağıtılacağını ve insansız hava aracı gibi kenar sistemlere girmeyeceğini belirtti.

Çevrildiğinde şöyle olur: Sen bak, sen denetle, olan biteni gör. Bir sorun çıkarsa, birlikte sorumluluk alırız, açıklama talebiyle bana gelme.

“Kurallar sıkı, ben uygularım” ve “Ben yerleşik olurum, sen denetlersin,” bu iki tamamen farklı güç ilişkisidir ve Pentagon sadece ikincisini kabul eder.

OpenAI'nin En İyi Olduğu Şey, Pentagon'un Tam Olarak İstediği Şey

Burada açıklanması gereken biraz rahatsız edici bir çelişki var.

OpenAI'nin Pentagon'a vaat ettiği "teknik şeffaflık" ve "sürekli izleme", kendi kullanıcıları üzerinde zaten uygulandı.

2025 yılının Ağustos ayında, OpenAI, kullanıcıların zihinsel sağlık krizi hakkındaki resmi bir blog yazısında, bir tür yeni izleme mekanizmasını açıklayarak açığa vurdu: Sistem, kullanıcının "başkalarına zarar verme planı yaptığını" tespit ettiğinde, sohbet özel bir kanala yönlendirilecek ve eğitimli bir insan denetim ekibi tarafından ele alınacak, bu denetçilere durumu yetkili makamlara bildirme yetkisi verildi. Bu OpenAI tarafından proaktif olarak açıklanan ancak zihinsel sağlığa odaklanan uzun bir makalenin ortasına gömülmüş, sakin bir şekilde karşılanan bir durumdu.

2026 yılının Şubat ayında, yani bu sözleşmeden kısa bir süre önce, OpenAI reklam sistemi başlattı ve gizlilik politikasını güncelledi ve şunu netleştirdi: Ücretsiz ve temel ücretli kullanıcılar ChatGPT'yi kullanırken, sistem "sohbet içi bağlam analizi" yapacak ve sohbet konusuna göre ilgili reklamları kullanıcılara gösterecekti. Örneğin, yemek tarifleri hakkında konuşuyorsanız, yemek teslim hizmeti reklamlarını görebilirsiniz. OpenAI, sohbet içeriğinin reklamverene iletilmeyeceğini vurguladı, ancak analiz davranışının gerçek zamanlı olarak gerçekleştiğini belirtti. Reklamlar 9 Şubat'ta test edilmeye başlandı.

2025 yılının Kasım ayında, OpenAI'nin üçüncü taraf analiz hizmeti sağlayıcısı Mixpanel, bir saldırıya uğradı ve bazı API kullanıcılarının adını, e-postasını, yaklaşık coğrafi konumunu, işletim sistemini ve tarayıcı bilgilerini sızdırdı. OpenAI daha sonra Mixpanel ile olan işbirliğini sonlandırdı, şu anda dava açıldı. Olayın başlıca etkilediği kullanıcılar API geliştiricileriydi, genel ChatGPT kullanıcılarını etkileyen kısım ise platform aracılığıyla yardım merkezi talebi gönderenlerdi.

İşte Pentagon'a "teknik şeffaflık, sürekli izleme, her şeyin gerçekleştiğini görmenize izin verme" sözü veren şirket.

En iyi yapabildiği şey, başkalarına içeri bakmak için olanıdır, çünkü kendisini buna maruz bırakmayı alışkanlık haline getirmiştir.

Anthropic, kuralların kullanımı tarafından kısıtlanabileceğine inanırken, OpenAI, kendi insanlarını içine yerleştirmenin herhangi bir hükümden daha etkili olduğuna inanıyor. İlki idealist uyum mantığına dayanırken, ikincisi gerçekçi etki mantığına dayanır. Pentagon ikinciyi seçti, çünkü onun için daha tanıdık ve daha kontrol edilebilir.

Ortada Neler Oldu?

Zamanı çevirerek başa dönelim, 28 Şubat sabahına, Doğu Amerika zamanına göre 27 Şubat öğleden sonra 5:01'e.

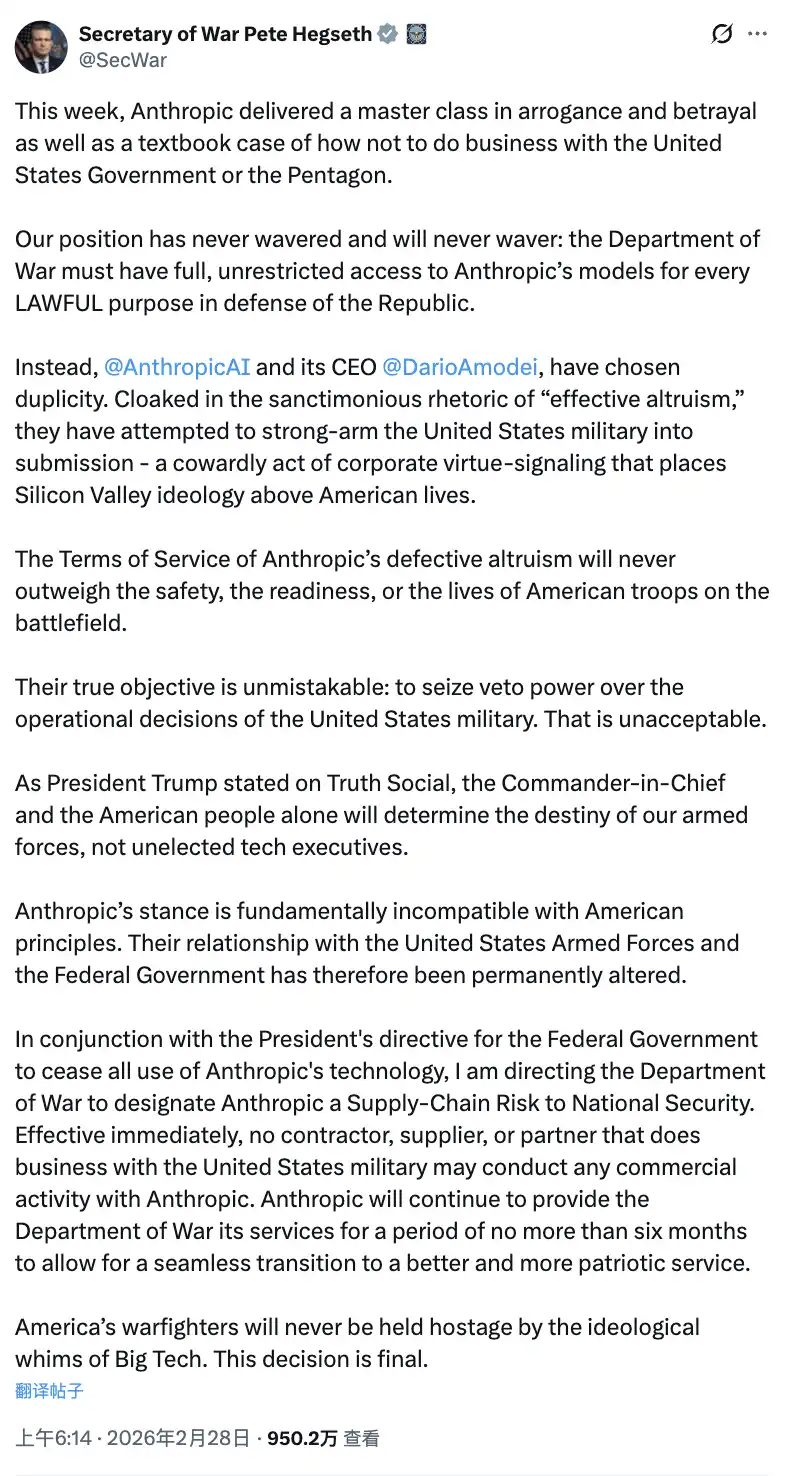

Anthropic'ın son uyarı saati geldi. Dario taviz vermedi. Trump, Truth Social'da yasaklamayı duyurdu, Hegseth ise X'te Anthropic'i "tedarik zinciri riski" olarak listeledi, Anthropic yasal yollara başvuracağını duyurdu.

Hegseth'in açıklamasında dikkat çeken bir cümle vardı: "Anthropic'in tutumu, Amerikan ilkeleriyle temelde çelişiyor." Ardından, aynı açıklamada, Anthropic'in Savunma Bakanlığı'na "daha pürüzsüz bir geçiş için altı ayı aşmayacak şekilde hizmet vermeye devam edebileceğini" belirtti. Yani, bir şirketi ulusal güvenlik riski olarak tanımladılar ve hala bu şirketin ürünlerini kullanmaya devam ediyorlar. Bu mantıksal çelişkiyi kimse açıklayamadı.

Birkaç saat sonra, Altman o tweet'i attı.

O günün başlarında yaptığı tüm çalışan toplantısına dönüp baktığımızda: OpenAI'in durumu sakinleştirmesine ve "tüm endüstri için bir çerçeve oluşturabilecek" bir çözüm bulmasına yardımcı olmayı umduğunu söyledi. Bu, bekleyen birinin ses tonu değil.

Bu, Silicon Valley'in bu tür operasyonları ilk defa gördüğü anlamına gelmiyor.

2023'te, OpenAI'in kar amacı gütmeyen yönetim kurulu, Altman'ı "yeterince dürüst olmamakla" işten çıkardı, ilerleme hızını fazla buldu ve iç iletişim sorunları olduğunu belirtti. Beş gün sonra, Altman, çalışanların toplu destek mektubuyla geri döndü, yönetim kurulu dağıldı. Ardından şirketi kar amacı gütmeyen bir yapıdan kar amacı güden bir kuruluşa yeniden yapılandırmak için öncülük etti ve şirketin kısıtlayıcı haklarını içeren kar amacı gütmeyen misyonu, yeni bir yasal çerçeveye dahil edildi.

Bu sefer, buna "ortak bir çerçeve bulma" denildi.

Dario Ne Kaybetti?

Jerry McGinn, Amerikan Stratejik ve Uluslararası Çalışmalar Merkezi Endüstriyel Temeller Araştırma Merkezi Direktörü, bu olaya soğukkanlı bir değerlendirmede bulundu: "Bu Anthropic için mükemmel bir itibar, ve onlar aslında o 2 milyar doları hiçe sayabilirlerdi."

Bu değerlendirme mali açıdan doğrudur. Anthropic'in 2025 yıllık geliri 140 milyar dolar, değeri 3.8 trilyon dolar, en büyük hissedarı Amazon, hükümetin bir yasak emri nedeniyle yatırım mantığını yeniden gözden geçirmeyecek. Hukuki yollar dönüm noktası getirebilir. IPO değerlemesi muhtemelen önemli bir zarar görmeyecek, "hükümet baskısını reddetmek, güvenlik ilkelerine bağlı kalmak" hikayesi, muhtemelen eşdeğer etkiyi satın alabilecek hiçbir itibar bütçesi bulunmuyor.

Ancak, Dario kaybetti.

AI'nın askeri alandaki gerçek dünya kullanım standartları, Anthropic yerine Pentagon içinde OpenAI tarafından belirlenecek. O gizli ağa gömülü güvenlik yığını, güvenlik lisansına sahip OpenAI araştırmacıları, AI davranışlarını sürekli izleyen izleme sistemleri. Bunlar, önümüzdeki yıllarda endüstri standardı haline gelecek.

Anthropic, pozisyonunu korumak için prensiplerine sıkı sıkıya bağlı kaldığı için, kuralların oluşturulma sürecindeki koltuğunu kaybetti.

O koltuğa oturan kişi, "destekleme"den "imzalama"ya dönüşümü on iki saatten az bir sürede tamamlayan aynı kişiydi.

En ironik olanı şudur: AI güvenliğine en ciddi yaklaşan şirket, AI güvenliğine en ciddi yaklaşımın gerektiği yerden çıkarıldı.

Onun yerine giren şirket ise, kullanıcı konuşmalarını reklam sistemine entegre etme mekanizmasını yalnızca iki hafta önce piyasaya sürdü, üç ay önce üçüncü taraf veri sızıntısı yaşadı, daha önce ise kullanıcıları kolluk kuvvetlerine bildirebilecek bir sohbet tarama sistemini gizlice açıkladı.

Silikon Vadisi'nde, Altman'ın on iki saatten az süren bu hamlesi bir isme sahiptir. İhanet denmez, zamanlamadır.

BlockBeats Resmi Topluluğuna Katılın:

Telegram Abonelik Grubu: https://t.me/theblockbeats

Telegram Sohbet Grubu: https://t.me/BlockBeats_App

Twitter Resmi Hesabı: https://twitter.com/BlockBeatsAsia