Google AI'nin 900 milyar dolarlık depolama hissesini çökerten makale, deney hileleriyle suçlandı.

Orijinal Başlık: "Google AI Makalesiyle 900 Milyar Dolarlık Depolama Hisse Çökertildi, Deney Sahtekarlığı İddiasıyla Karşı Karşıya"

Orijinal Kaynak: Derin Akıntı TechFlow

Google'ın "AI Bellek Kullanımını 1/6'ya Sıkıştıran" iddialı bir makalesi, geçen hafta Micron, SanDisk gibi küresel depolama yongası şirketlerinin toplam 900 milyar dolarlık piyasa değerini buharlaştırdı.

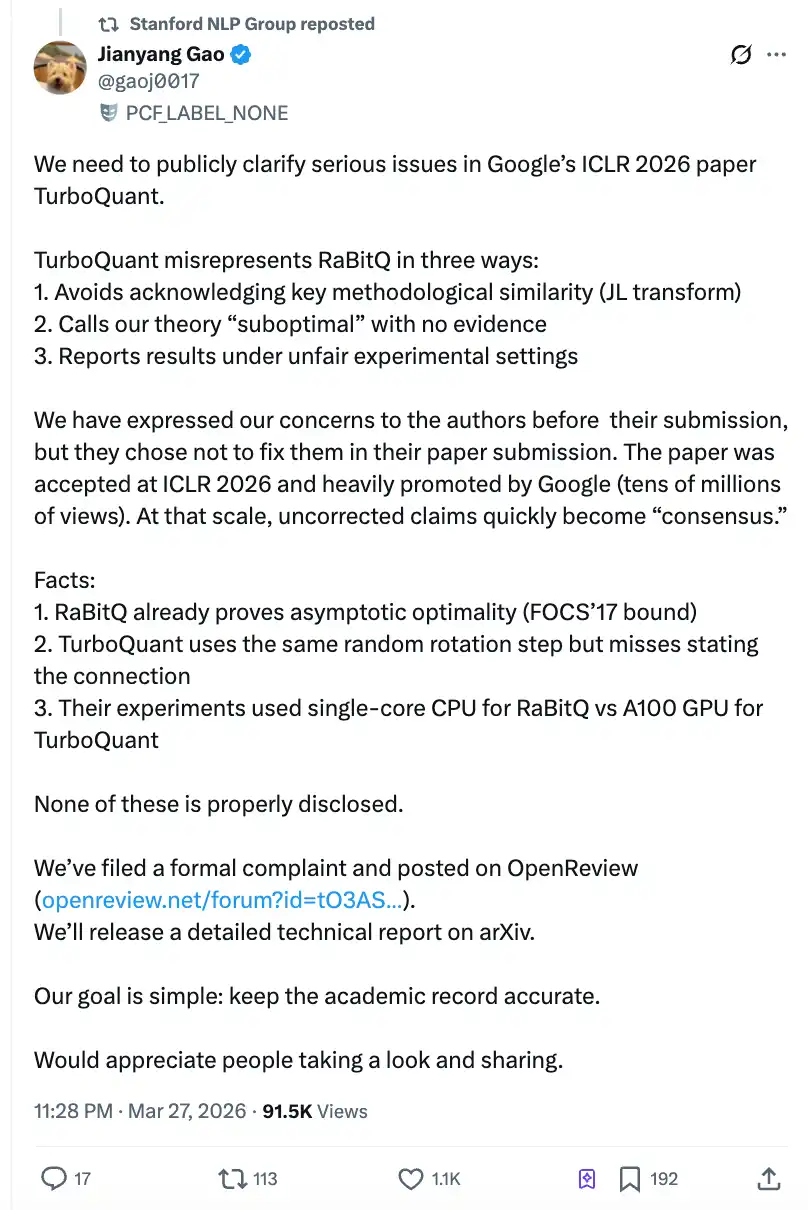

Ancak makale yalnızca iki gün yayınlandıktan sonra, algoritmanın "ezdiği" karşı taraf—Zürih Federal Teknoloji Enstitüsü doktora sonrası araştırmacısı Gao Jianyang, binlerce kelime içeren bir açık mektup yayımlayarak Google ekibini, deneyde rakip olarak tek çekirdekli CPU'nun Python komut dosyasıyla test yaparken kendilerinin ise A100 GPU ile test yaptığını ve gönderim öncesinde sorunun kendilerine bildirilmesine rağmen düzeltmeyi reddettiklerini suçladı. Zhihu'da okunma sayısı hızla 4 milyonu aşarken, Stanford NLP resmi hesabı tarafından yeniden paylaşıldı ve akademik dünya ile piyasa aynı anda sarsıldı.

Bu tartışmanın asıl sorunu çok karmaşık değil: Google'ın resmi olarak büyük çapta tanıttığı, doğrudan küresel çip sektöründe paniğe yol açan 900 milyar dolarlık bir pazar değeri kaybına neden olan bir AI üst konferans makalesi, zaten yayımlanmış bir önceki çalışmayı sistematik olarak çarpıttı mı ve kasıtlı olarak adaletsiz deneylerle yanıltıcı bir performans üstünlüğü hikayesi oluşturdu mu?

TurboQuant Ne Yaptı: AI'nin "Taslak Kağıdı"nı Orijinalinin Altıda Birine İndirdi

Büyük dil modelleri cevap üretirken, daha önce hesaplanan içeriği yazarken ve geri dönerken ihtiyaç duyar. Bu ara sonuçlar geçici olarak bellekte tutulur ve endüstri bu duruma "KV Önbellek" (Anahtar Değer Önbelleği) adını verir. Diyalog uzadıkça, bu "taslak kağıdı" kalınlaşır, bellek tüketimi artar ve maliyeti yükselir.

Google Araştırma Ekibi tarafından geliştirilen TurboQuant algoritması, bu taslak kağıdını orijinalin altıda birine sıkıştırmanın özelliğini taşıyor ve aynı zamanda sıfır hassasiyet kaybı iddia ediyor, çıkarım hızını en fazla 8 kat artırıyor. Makale, 2025 Nisan ayında ilk kez akademik öncesi arXiv platformunda yayınlandı, 2026 Ocak ayında AI alanının önde gelen konferansı ICLR 2026 tarafından kabul edildi ve 24 Mart'ta Google'ın resmi blogunda yeniden paketlenerek tanıtıldı.

Teknik olarak, TurboQuant'ın yaklaşımı basitçe şu şekilde anlaşılabilir: Karmaşık verileri önceden belirlenmiş en iyi sıkıştırma tablosuyla sıkıştırmak için bir matematiksel dönüşüm kullanmak, ardından sıkıştırılmış verileri olası hesaplama yanlışlarını düzeltmek için 1-bitlik bir hata düzeltme mekanizmasıyla incelemek. Topluluk tarafından bağımsız olarak uygulanan, sıkıştırma etkisinin temelde doğru olduğu doğrulandı ve algoritmanın matematiksel katkısı gerçekten var.

Tartışma, TurboQuant'ın kullanılabilirliği ile ilgili değil, Google'ın "rakiplerini açıkça geride bıraktığını" kanıtlamak için ne yaptığıyla ilgilidir.

Gao Jianyang Açık Mektup: Üç Suçlama, Hepsi Çelişiyor

27 Mart akşamı saat 10'da, Gao Jianyang, uzun bir yazıyı Zhihu'da yayınladı ve aynı anda ICLR resmi inceleme platformu OpenReview'e resmi bir yorum gönderdi. Gao Jianyang, RaBitQ algoritmasının ilk yazarıdır ve bu algoritma, 2024 yılında veritabanı alanında önde gelen bir konferans olan SIGMOD'da yayınlandı, aynı tür sorunu çözer—yüksek boyutlu vektörlerin etkili sıkıştırılması.

Suçlamaları üçe ayırıyor, her biri e-posta kayıtları ve zaman çizelgesi ile desteklenmiş.

Suçlama Bir: Başkasının temel yöntemini kullandı, tamamı belirtilmedi.

TurboQuant ve RaBitQ'nun teknik çekirdeği arasında temel bir ortak adım bulunmaktadır: Verileri sıkıştırmadan önce verilere bir kez "rastgele dönüş" yapma. Bu adımın amacı, başlangıçta düzensiz dağılıma sahip verileri öngörülebilir homojen bir dağılıma dönüştürerek sıkıştırma zorluğunu büyük ölçüde azaltmaktır. Bu, iki algoritmanın en temel, en benzer kısmıdır.

TurboQuant'ın yazarları da bu konuyu inceleme yanıtlarında kabul etti, ancak makalenin tam metninde bu yöntemin RaBitQ ile ilişkisini açıkça belirtmediler. Daha da önemlisi, TurboQuant'ın ikinci yazarı Majid Daliri, 2025 yılı Ocak ayında Gao Jianyang ekibine, RaBitQ koduna dayalı olarak yazdığı Python versiyonunu hata ayıklamak için yardım istediğinde, bilerek Gao Jianyang ekibiyle iletişime geçti. E-postada, yeniden üretme adımları ve hata ile ilgili bilgiler detaylı olarak açıklandı—başka bir deyişle, TurboQuant ekibi RaBitQ'nun teknik detaylarına son derece hakim.

Bir ICLR anonim hakem de her iki algoritmanın aynı teknolojiyi kullandığını bağımsız olarak belirterek tam tartışma talep etti. Ancak son makalede, TurboQuant ekibi sadece ekleme yapmadı, aksine orijinal metinde RaBitQ'a (zaten eksik olan) açıklamayı eklerken bunu ekte taşıdılar.

Suçlama İki: Kanıtsız bir şekilde rakibin teorisini "alt optimal" olarak nitelendirdi.

TurboQuant makalesi doğrudan RaBitQ'ya "teoride alt-optimal" etiketini yapıştırdı, nedeni RaBitQ'nun matematiksel analizinin "oldukça kaba" olduğuydu. Ancak Gao Jianyang, RaBitQ'nun genişletilmiş makalesinin sıkıştırma hatasının matematiksel olarak en iyi sınıra ulaştığını sıkı bir şekilde kanıtladığını belirtiyor—bu sonuç, teorik bilgisayar bilimi alanının önde gelen konferanslarında yayınlandı.

2025 Mayıs'ında, Gao Jianyang ekibi RaBitQ teorisinin eniyiliği hakkında detaylı açıklamalar yapmıştı. TurboQuant'un ikinci yazarı Daliri, tüm yazarlara bilgi verdiğini doğruladı. Ancak makale sonuçta hala "ikincil" ifadesini korudu ve herhangi bir çürütme argümanı sunmadı.

İddia Üç: Deney Karşılaştırmasında "Sol El Bağlı, Sağ Elde Bıçak"

Bu, metindeki en yıkıcı iddialardan biridir. Gao Jianyang, TurboQuant makalesinin hız karşılaştırması deneyinde iki katmanlı haksız koşullar eklediğini belirtti:

İlk olarak, RaBitQ resmi olarak optimize edilmiş C++ kodu sağladı (varsayılan olarak çoklu iş parçacığı paralelliğini destekler), ancak TurboQuant ekibi bunu kullanmadı ve RaBitQ'yu test etmek için kendi çevirdikleri Python sürümünü kullandı.

İkinci olarak, RaBitQ'yu test etmek için tek çekirdekli bir CPU ve çoklu iş parçacığını kapatan TurboQuant ise NVIDIA A100 GPU kullandı.

Bu iki koşulun bir araya gelmesi sonucunda, okuyucuların gördüğü sonuç "RaBitQ'nun TurboQuant'tan birkaç kat daha yavaş olduğu" şeklindeydi, ancak bu sonucun öncülünün Google ekibinin rakibi elleri bağlı bir şekilde yarıştırması olduğu fark edilemedi. Makalede bu deney koşullarının farklılıkları yeterince açıklanmamıştı.

Google'ın Yanıtı: "Rastgele Dönüşüm Genel Bir Teknolojidir, Her Makaleyi Alıntılamak Mümkün Değil"

Gao Jianyang'ın açıklamasına göre, TurboQuant ekibi mart 2026'da yaptıkları e-posta yanıtlarında, "Rastgele dönüşüm ve Johnson-Lindenstrauss dönüşümünün kullanımı bu alanın standart teknikleri haline gelmiştir, bu yöntemleri kullanan her makaleyi alıntılamak imkansızdır" dedi.

Gao Jianyang ekibi, bunun kavramı değiştirme olduğunu düşünüyor: Sorun, tüm rastgele dönüşüm kullanan makaleleri alıntı yapmak mı, yoksa RaBitQ'nun tamamen aynı soru kurulumunda, bu yöntemi vektör sıkıştırma ile ilk kez birleştiren ve eniyiliğini kanıtlayan çalışma olan bir makaleye atıfta bulunmamak mıdır. TurboQuant makalesinin bu ilişkiyi doğru bir şekilde açıklaması gerekiyordu.

Stanford NLP Grubu resmi X hesabı Gao Jianyang'ın açıklamasını yeniden paylaştı. Gao Jianyang ekibi ICLR OpenReview platformunda açık yorum yayınladı ve ICLR konferans başkanına ve etik komitesine resmi şikayette bulundu, gelecekte ayrıca arXiv'de ayrıntılı teknik rapor yayınlayacak.

Uzman teknik blog yazarı Dario Salvati, analizinde TurboQuant'ın matematiksel açıdan gerçek bir katkı sağladığını ancak RaBitQ ile olan ilişkisinin makalenin ifade ettiğinden çok daha yakın olduğunu belirtti.

900 Milyar Dolarlık Piyasa Değeri Kaybı: Makale Tartışmasıyla Birleşen Piyasa Panik

Bu akademik tartışmanın yaşandığı zamanlama son derece hassastı. Google, 24 Mart tarihinde resmi blogu aracılığıyla TurboQuant'ı duyurduktan sonra, küresel depolama yonga sektörü şiddetli bir satış baskısıyla karşılaştı. CNBC ve diğer birçok medya kuruluşunun haberlerine göre, Micron Technology altı art arda işlem gününde düşüş yaşadı ve toplamda %20'den fazla değer kaybetti; SanDisk'in tek günlük düşüşü %11'i buldu; Güney Kore merkezli SK Hynix %6'ya yakın, Samsung Electronics yaklaşık %5, Japon Kioxia yaklaşık %6 oranında düştü. Piyasa panik mantığı oldukça basitti: Yazılım sıkıştırması yapay zeka çıkarımı için bellek gereksinimini 6 kat düşürebilir, bu da depolama yonga talebinin yapısal olarak aşağı yönlü olacağı anlamına gelir.

Morgan Stanley analisti Joseph Moore, 26 Mart tarihli bir raporunda bu mantığı çürüttü ve Micron ve SanDisk'e "Tut" tavsiyesini sürdürdü. Moore, TurboQuant'ın sadece belirli bir tür önbellek olan KV Cache'i sıkıştırdığını ve bu durumun genel bellek kullanımını değil, "normal verimlilik iyileştirmesi" olarak nitelendirdiğini belirtti. Wells Fargo analisti Andrew Rocha da Jevons Paradoksu'na atıfta bulunarak, verimliliğin maliyetleri düşürmenin ardından daha büyük ölçekli bir yapay zeka dağıtımını teşvik edebileceğini ve sonuç olarak bellek talebini artırabileceğini savundu.

Eski Makale, Yeni Paketleme: Yapay Zeka Araştırmasından Piyasa Anlatısına İletken Riski

Teknoloji blog yazarı Ben Pouladian'ın analizine göre, TurboQuant makalesi aslında 2025 Nisan ayında zaten açıklandı ve yeni bir araştırma değildi. Google'ın 24 Mart'ta resmi blog aracılığıyla yeniden paketleyip tanıtmasıyla, piyasa bunu tamamen yeni bir atılım olarak değerlendirdi. Bu "eski makale, yeni yayın" tanıtım stratejisi, makalede olası deneysel sapmalarla birleşerek, yapay zeka araştırmasının akademik makaleden piyasa hikayesine ileten zincirdeki sistemik riskleri yansıttı.

Yapay zeka altyapısı yatırımcıları için, bir makalenin "çoklu kat performans artışı" iddiasını gerçekleştirdiğinde, ilk olarak yapılması gereken şey, karşılaştırma referansının adil olup olmadığını sorgulamaktır.

Gao Jianyang ekibi, sorunun resmi çözümü için çalışmalarına devam edeceklerini açıkça belirtti. Google henüz açık mektuptaki belirli suçlamalara resmi bir yanıt vermedi.

BlockBeats Resmi Topluluğuna Katılın:

Telegram Abonelik Grubu: https://t.me/theblockbeats

Telegram Sohbet Grubu: https://t.me/BlockBeats_App

Twitter Resmi Hesabı: https://twitter.com/BlockBeatsAsia